AI 휴머나이저

AI가 생성한 텍스트를 인간과 같은 글쓰기로 바꿔보세요. 정제된 콘텐츠는 명확성을 유지하면서 탐지를 줄입니다.

🎉 연간 플랜 가입 시 7개월 무료 혜택 - 위험 부담 없이 언제든 해지 가능

6

HR

0

MIN

0

SEC

지원되는 언어:

Korean

English

French

Spanish

All others

1 신용 비용

감지 모드

기초적인

전진

선택적 추가 기능

문장 분석

상세한 문장 수준 감지

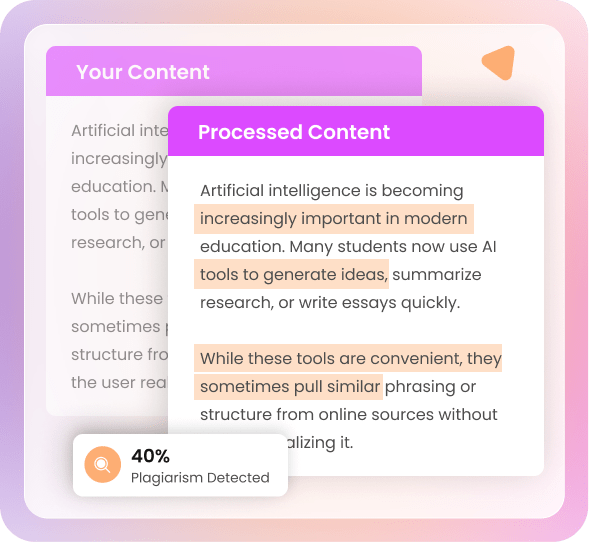

표절검사기

복사한 텍스트를 온라인으로 스캔하세요

AI 이미지 감지기

Check if an image is AI-generated

AI 탐지기는 문단 수준 탐지, 문장 수준 탐지 및 단어 수준 분석을 통해 AI가 작성한 콘텐츠를 탐지합니다. 또한 AI 어휘, 자주 사용되는 AI 단어 및 과도하게 사용되는 단어를 평가합니다.

AI 탐지기는 문서 수준 탐지를 적용하여 AI가 생성한 문서와 사람이 생성한 문서가 혼합된 문서를 스캔합니다. AI 검사기는 AI가 생성한 패턴을 정확한 결과로 검증합니다.

AI Checker는 복사된 콘텐츠, 의도치 않은 표절, 중복 콘텐츠를 감지합니다. CudekAI 표절 검사기는 에세이, 기사, 연구 논문 및 웹 콘텐츠를 스캔하여 콘텐츠의 독창성을 검증합니다.

CudekAI은 AI 탐지 및 표절 검사를 결합하여 완벽한 독창성 분석을 제공합니다.

AI 표절검사기CudekAI 이미지 검출기는 AI가 생성한 시각 자료를 스캔합니다. 지원되는 여러 형식에서 AI 이미지의 진위 여부를 검증합니다. AI 이미지 검사기는 시각 콘텐츠를 검토하여 AI 생성 확률을 점수로 매깁니다.

이미지 검출기는 AI 비율과 시각적 AI 점수를 사용하여 결과를 분류하고, 명확하고 체계적인 이미지 분석을 통해 정확한 검증을 지원하며, AI 가능성을 낮음, 중간 또는 높음으로 표시합니다.

AI 이미지 감지기

AI가 생성한 텍스트를 인간과 같은 글쓰기로 바꿔보세요. 정제된 콘텐츠는 명확성을 유지하면서 탐지를 줄입니다.

고급 감지 알고리즘을 통해 복사된 콘텐츠를 감지하고 우발적인 표절을 식별합니다.

문법, 구두점, 문장 구조를 식별하고 수정합니다. 한 번의 클릭으로 가독성이 향상됩니다.

어조, 구조, 가독성 점수를 검토하여 제출하기 전에 간과된 실수를 찾아보세요.

영어, 스페인어, 프랑스어, 독일어, 일본어, 헝가리어 등의 AI 글쓰기를 감지합니다.

원래 의도와 맥락을 유지하면서 콘텐츠를 104개 언어로 번역합니다.

AI 패턴, 표절, 구조화에 대한 에세이를 확인하세요. 공정한 평가를 돕습니다.

긴 문서를 간결한 요약으로 변환하세요. 집중된 요약으로 정보를 직접적으로 유지합니다.

핵심 의도를 잃지 않으면서 명확성을 높이고 반복을 피하기 위해 문장을 다시 작성하세요.

가독성과 흐름을 높이기 위해 동의어를 사용하여 문장과 단락을 바꿔보세요.

확인 프로세스를 시작하려면 텍스트를 직접 붙여넣으세요. URL을 입력하거나 DOCX, PDF, TXT 또는 RTF 파일을 업로드하세요. CudekAI AI 감지기는 최대 15,000자를 스캔합니다.

AI 검사기를 실행하여 단어, 문장, 단락 및 문서 수준 분석을 수행하십시오. AI 탐지기는 AI가 생성한 콘텐츠와 표절 콘텐츠를 자동으로 검사합니다.

CudekAI 탐지기는 몇 초 만에 텍스트를 스캔합니다. 자세한 보고서를 PDF 및 DOCX 형식으로 다운로드하거나 공유 가능한 링크를 생성하세요.

최고 AI 모델들이 생성한 AI 콘텐츠를 감지합니다.

GPT-5, GPT-4, GPT-3, GPT-4.1 및 GPT-4.1-Mini에서 생성된 콘텐츠를 감지합니다. 정확한 AI 확률 점수 계산으로 신뢰할 수 있는 분석을 보장합니다.

CudeKAI AI 체커는 구조적 분석을 통해 Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash 및 Gemini 2.5 Flash-Lite에서 텍스트를 감지합니다.

클로드의 소네트 4번에서 문장 수준 및 문서 수준 분석을 사용하여 로봇이 작성한 텍스트를 식별합니다.

AI 탐지기는 라마가 생성한 언어 패턴을 식별합니다.

적응형 AI 지문 분석을 통해 DeepSeek 모델에서 생성된 텍스트를 감지합니다.

모델 간 비교 논리를 사용하여 Grok이 생성한 AI 작성 콘텐츠를 분석합니다.

CudekAI은 높은 정확도의 모델을 사용하여 신뢰할 수 있는 AI 탐지를 수행합니다. 독립적인 벤치마킹과 대규모 테스트를 통해 탐지 정확도가 검증되었습니다. 이 AI 탐지 모델은 오탐지 및 오분류를 최소화하며, 벤치마킹 결과는 여러 AI 모델에서 일관된 성능을 보여줍니다.

CudekAI은 여러 교육 기관, 대학 및 연구 기관의 교사, 학생 및 연구원들에게 신뢰받고 있습니다. 학교 시스템은 AI 탐지기를 사용하여 에세이, 논문 및 블로그 콘텐츠에서 AI를 검사하고 정확한 검증을 수행합니다.

카피라이터, 마케터, 채용 담당자, 출판사 및 작가들은 이 시스템의 정확한 AI 탐지 점수에 의존합니다. 모든 제출물은 분석되어 중요한 콘텐츠가 독창성 기준을 충족하는지 확인합니다.

콘텐츠를 입력하고 API 접근 권한을 얻어 자동화된 검사를 수행하는 API 통합 도구입니다. 이 API는 AI 탐지, 표절 검사, 의역 및 번역 기능을 지원합니다.

지금 바로 API 접근 권한을 확보하세요.

무료 Ai 콘텐츠 감지기 도구는 103 언어로 제공됩니다.

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Cudekai의 AI 탐지기는 정말 스트레스 해소에 큰 도움이 되었습니다. 제 교수님들 중 일부는 AI가 작성한 과제에 대해 엄격하신데, 이 도구 덕분에 제출하기 전에 제 과제가 진짜처럼 보인다는 확신을 가질 수 있었습니다.

Daniel

저는 논문 작성을 마친 후 Cudekai의 휴머나이저 도구를 사용하여 제 글이 실제로 제 말투와 일치하는지 확인합니다. 이 도구는 글을 매끄럽게 다듬고 모든 내용이 자연스럽게 흐르도록 만들어 줍니다. 마치 제 목소리처럼 들리지만 훨씬 더 세련된 느낌이죠.

Chelsea

문장을 다듬다가 막힐 때마다 Cudekai의 재작성 도구에 입력하기만 하면 됩니다. 몇 초 만에 더 깔끔하고 명확한 버전으로 바꿔줘서 다른 작업에 쓸 시간을 많이 절약할 수 있어요.

Ricardo

Cudekai의 표절 검사기는 정말 훌륭합니다. 보고서가 상세하면서도 이해하기 쉬워서 문제를 훨씬 빠르게 수정할 수 있습니다. 제 프로젝트에는 필수품입니다.

Michael