Humanizér umělé inteligence

Proměňte texty generované umělou inteligencí v text podobný lidskému. Vylepšený obsah snižuje riziko detekce a zároveň zachovává srozumitelnost.

🎉 Získejte 7 měsíců ZDARMA s jakýmkoli ročním tarifem – bez rizika, můžete kdykoli zrušit

6

HR

0

MIN

0

SEC

Podporované jazyky:

Czech

English

French

Spanish

All others

1 Úvěrové náklady

Režim detekce

Základní

Záloha

Volitelné doplňky

Analýza vět

Detailní detekce úrovně vět

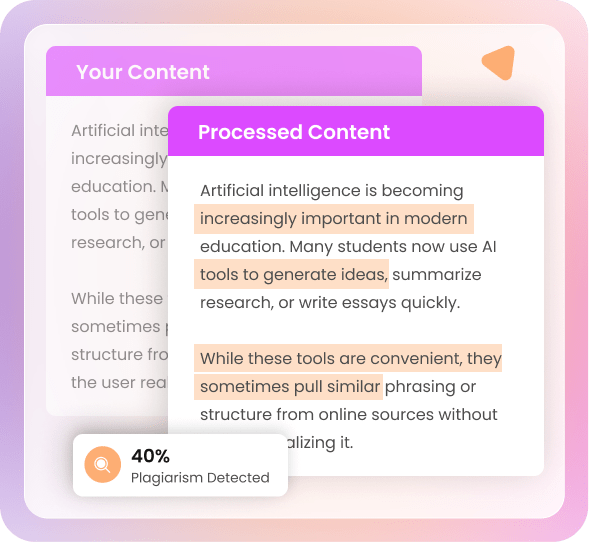

Kontrola plagiátorství

Naskenujte zkopírovaný text online

Detektor obrazu s umělou inteligencí

Check if an image is AI-generated

AI Detector detekuje psaný obsah AI pomocí detekce na úrovni odstavce, detekce na úrovni vět a analýzy na úrovni slov. Hodnotí slovní zásobu umělé inteligence, běžně používaná slova umělé inteligence a nadměrně používaná slova.

Detektor AI používá detekci na úrovni dokumentu ke skenování smíšených dokumentů, a to jak AI, tak lidmi vytvořených. CudekAI AI Checker ověřuje vzory generované AI s přesnými výsledky.

AI Checker detekuje zkopírovaný obsah, náhodné plagiátorství a duplicitní obsah. Detektor plagiátů CudekAI skenuje eseje, články, výzkumné práce a webový obsah, aby ověřil originalitu obsahu.

CudekAI kombinuje detekci pomocí umělé inteligence a skenování plagiátorství pro kompletní analýzu originality.

Kontrola plagiátorství pomocí umělé inteligenceDetektor obrázků CudekAI skenuje vizuály generované umělou inteligencí. Ověřuje pravost obrázků vytvořených umělou inteligencí v několika podporovaných formátech. Kontrolor obrázků s umělou inteligencí kontroluje vizuální obsah a hodnotí pravděpodobnost použití umělé inteligence.

Detektor obrazu klasifikuje výsledky pomocí míry umělé inteligence a vizuálního skóre umělé inteligence, čímž indikuje nízké, střední nebo vysoké možnosti využití umělé inteligence s jasnou a strukturovanou analýzou obrazu pro přesné ověření.

Detektor obrazu s umělou inteligencí

Proměňte texty generované umělou inteligencí v text podobný lidskému. Vylepšený obsah snižuje riziko detekce a zároveň zachovává srozumitelnost.

Detekuje kopírovaný obsah a identifikuje náhodné plagiátorství pomocí pokročilých detekčních algoritmů.

Identifikujte a opravte gramatiku, interpunkci a strukturu vět. Zlepšete čitelnost jedním kliknutím.

Před odesláním zkontrolujte tón, strukturu a čitelnost, abyste odhalili přehlédnuté chyby.

Detekce textu vytvořeného umělou inteligencí v angličtině, španělštině, francouzštině, němčině, japonštině, maďarštině a dalších jazycích.

Překládejte obsah do 104 jazyků a zachovávejte původní záměr a kontext.

Kontroluje eseje na přítomnost vzorů umělé inteligence, plagiátorství a strukturování. Pomáhá se spravedlivým hodnocením.

Převeďte dlouhé dokumenty na stručná shrnutí. Cílené shrnutí udržuje informace přehledné.

Přepište věty tak, aby byly srozumitelnější a vyhnuly se opakování, aniž by se ztratil klíčový záměr.

Přeformulujte věty a odstavce pomocí synonym pro lepší čitelnost a plynulost.

Vložte text přímo pro spuštění procesu kontroly. Zadejte URL adresu nebo nahrajte soubory DOCX, PDF, TXT nebo RTF. Detektor umělé inteligence CudekAI skenuje až 15 000 znaků.

Spusťte kontrolu umělé inteligence a proveďte analýzu na úrovni slov, vět, odstavců a dokumentů. Detektor umělé inteligence automaticky vyhledává obsah generovaný umělou inteligencí a plagiát.

Detektor CudekAI naskenuje text během několika sekund. Stáhněte si podrobnou zprávu ve formátu PDF a DOCX nebo vytvořte odkaz ke sdílení.

Detekce obsahu umělé inteligence generovaného špičkovými modely umělé inteligence

Detekuje obsah generovaný algoritmy GPT-5, GPT-4, GPT-3, GPT-4.1 a GPT-4.1-Mini. Přesné pravděpodobnostní skóre s využitím umělé inteligence zajišťuje spolehlivou analýzu.

CudeKAI Kontrolor s umělou inteligencí detekuje text v aplikacích Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash a Gemini 2.5 Flash-Lite pomocí strukturované analýzy.

Identifikujte robotický text z Claude Sonnet 4 pomocí analýzy na úrovni vět a dokumentů.

Detektor umělé inteligence identifikuje jazykové vzory produkované lamou.

Detekuje text generovaný modely DeepSeek s adaptivní analýzou otisků prstů s využitím umělé inteligence

Analyzujte obsah napsaný umělou inteligencí vytvořený Grokem pomocí logiky porovnávání mezi modely.

CudekAI používá vysoce přesný model pro spolehlivou detekci pomocí umělé inteligence. Nezávislé benchmarkingové testování a rozsáhlé testování ověřují přesnost detekce. Model detektoru pomocí umělé inteligence minimalizuje falešně pozitivní výsledky a chybné klasifikace, zatímco benchmarkové testy potvrzují konzistentní výkon napříč různými modely umělé inteligence.

CudekAI je důvěryhodný pro učitele, studenty a výzkumníky napříč akademickými institucemi, vysokými školami a univerzitami. Školský systém používá detektor umělé inteligence ke kontrole umělé inteligence v esejích, pracích a obsahu blogů za účelem přesného ověření.

Copywriteři, marketéři, náboráři, vydavatelé a autoři se spoléhají na jeho přesné skóre detekce pomocí umělé inteligence. Každý příspěvek je analyzován, aby se zajistilo, že obsah s vysokými sázkami splňuje standardy originality.

Nejlepší pro agentury

Credits: Tailored for You

AI detektor

Humanizátor

Kontrola plagiátorství

Detektor obrazu s umělou inteligencí

Všechny aplikace v ceně

Překladatel

Provádí hromadnou detekci pomocí umělé inteligence s integrací API zadáváním obsahu a získáváním přístupu API k detektoru umělé inteligence pro automatizované kontroly. API podporuje detekci pomocí umělé inteligence, kontrolu plagiátorství, parafrázování a překlad.

Získejte přístup k API ještě dnes.

Bezplatný nástroj pro detekci obsahu Ai je k dispozici v jazyce 103

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Detektor umělé inteligence od Cudekai mi skutečně ulevuje od stresu. Někteří z mých profesorů jsou na práce psané pomocí umělé inteligence přísní a tento nástroj mi dává jistotu, že mé práce vypadají autenticky, než je odevzdám.

Daniel

Po dokončení prací používám nástroj humanizér od Cudekai, abych se ujistil, že skutečně zní jako já. Vyhladí psaní a vše plyne přirozeně – jako můj vlastní hlas, jen lépe vybroušený.

Chelsea

Kdykoli se mi stane, že se snažím něco přeformulovat, prostě to vložím do přepisovače Cudekai. To mi během několika sekund poskytne čistší a srozumitelnější verze a ušetří mi to spoustu času na jinou práci.

Ricardo

Kontrola plagiátorství v Cudekai je opravdu solidní. Zprávy jsou podrobné, ale snadno srozumitelné, což značně urychluje opravu chyb. Je to pro mé projekty nutnost.

Michael