AI Humanizer

Változtassa a mesterséges intelligencia által generált szövegeket emberszerű írássá. A finomított tartalom csökkenti az észlelést, miközben megőrzi a tisztaságot.

🎉 7 hónap INGYENES előfizetés bármely éves csomaggal – kockázat nélkül, bármikor lemondható

6

HR

0

MIN

0

SEC

Támogatott nyelvek:

Hungarian

English

French

Spanish

All others

1 Hitelköltség

Érzékelési mód

Alapvető

Előleg

Opcionális kiegészítők

Mondatelemzés

Részletes mondat szintű észlelés

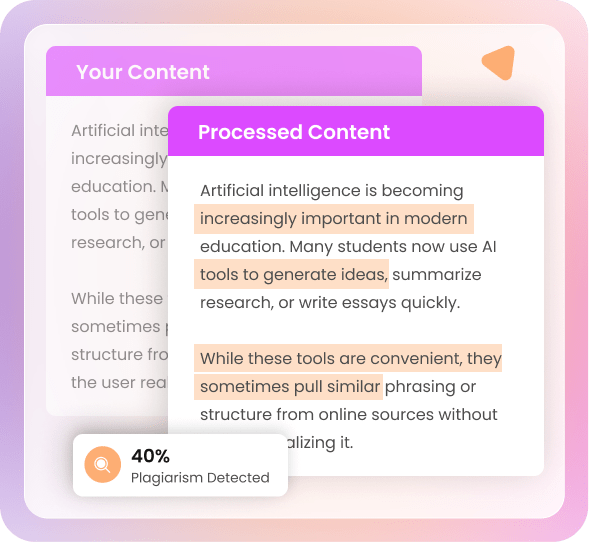

Plágium-ellenőrző

Szkennelje be a másolt szöveget online

AI képérzékelő

Check if an image is AI-generated

Az AI Detector bekezdés szintű, mondat szintű és szó szintű elemzéssel ismeri fel a mesterséges intelligencia által vezérelt írott tartalmakat. Értékeli a mesterséges intelligencia által használt szókincset, a gyakran használt szavakat és a túlzottan használt szavakat.

Az AI-detektor dokumentumszintű felismerést alkalmaz vegyes dokumentumok, mind mesterséges intelligencia által létrehozott, mind ember által generált dokumentumok beolvasásához. Az CudekAI AI-ellenőrző pontos eredményekkel ellenőrzi a mesterséges intelligencia által generált mintákat.

Az AI Checker másolt tartalmat, véletlen plágiumot és ismétlődő tartalmat észlel. A CudekAI plágiumdetektor esszéket, cikkeket, kutatási dolgozatokat és webes tartalmakat vizsgál a tartalom eredetiségének ellenőrzése érdekében.

A CudekAI mesterséges intelligencia alapú észlelést és plágiumvizsgálatot kombinál a teljes körű eredetiségelemzéshez.

AI Plágium-ellenőrzőA CudekAI Image Detector mesterséges intelligencia által generált vizuális tartalmakat vizsgál. Több támogatott formátumban ellenőrzi a mesterséges intelligencia által generált képek hitelességét. A mesterséges intelligencia által létrehozott képellenőrző áttekinti a vizuális tartalmat, és pontozza a mesterséges intelligencia valószínűségét.

A képdetektor mesterséges intelligencia ráta és vizuális mesterséges intelligencia pontszám alapján osztályozza az eredményeket, jelezve az alacsony, közepes vagy magas mesterséges intelligencia lehetőségeket, világos és strukturált képelemzéssel a pontos ellenőrzés érdekében.

AI képérzékelő

Változtassa a mesterséges intelligencia által generált szövegeket emberszerű írássá. A finomított tartalom csökkenti az észlelést, miközben megőrzi a tisztaságot.

Fejlett észlelő algoritmusok segítségével felismeri a másolt tartalmat és azonosítja a véletlen plágiumot.

A nyelvtani, írásjel- és mondatszerkezeti hibák azonosítása és javítása. Az olvashatóság javítása egyetlen kattintással.

A beküldés előtt tekintse át a hangnemet, a szerkezetet és az olvashatósági pontszámot a figyelmen kívül hagyott hibák kiszűrése érdekében.

Mesterséges intelligencia által írt írás észlelése angol, spanyol, francia, német, japán, magyar és más nyelveken.

Tartalom fordítása 104 nyelvre, miközben megőrzi az eredeti szándékot és kontextust.

Esszék ellenőrzése mesterséges intelligencia minták, plágium és strukturálás szempontjából. Segít a korrekt osztályozásban.

Hosszú dokumentumokat tömör összefoglalókká alakíthat. A fókuszált összefoglalás segít abban, hogy az információk közvetlenek maradjanak.

Írd át a mondatokat az érthetőség javítása és az ismétlések elkerülése érdekében, anélkül, hogy elveszítenéd a lényeget.

A mondatok és bekezdések átfogalmazása szinonimákkal az olvashatóság és a gördülékenység javítása érdekében.

Illesszen be közvetlenül szöveget az ellenőrzési folyamat elindításához. Adjon meg egy URL-t, vagy töltsön fel DOCX, PDF, TXT vagy RTF fájlokat. A CudekAI mesterséges intelligencia detektor legfeljebb 15000 karaktert képes beolvasni.

Futtassa a mesterséges intelligencia általi ellenőrzőt szó-, mondat-, bekezdés- és dokumentumszintű elemzéshez. A mesterséges intelligencia általi detektor automatikusan keresi a mesterséges intelligencia által generált és plágiumtartalmú tartalmakat.

A CudekAI detektor másodpercek alatt beolvassa a szöveget. Töltse le a részletes jelentést PDF és DOCX formátumban, vagy hozzon létre egy megosztható linket.

A legfontosabb MI-modellek által generált AI-tartalom észlelése

Észleli a GPT-5, GPT-4, GPT-3, GPT-4.1 és GPT-4.1-Mini által generált tartalmakat. A pontos AI valószínűségi pontozás megbízható elemzést biztosít.

CudeKAI A mesterséges intelligencia ellenőrzője strukturált elemzéssel érzékeli a szöveget a Gemini 3, a Gemini 2.5 Pro, a Gemini 2.5 Flash és a Gemini 2.5 Flash-Lite készülékekben.

Robotszöveg azonosítása Claude Sonnet 4-ből mondatszintű és dokumentumszintű elemzéssel.

A mesterséges intelligencia detektora azonosítja a láma által létrehozott nyelvi mintákat.

Adaptív AI ujjlenyomat-elemzéssel érzékeli a DeepSeek modellek által generált szöveget

Grok által létrehozott, mesterséges intelligencia által írt tartalom elemzése keresztmodell-összehasonlító logikával.

A CudekAI nagy pontosságú modellt használ a megbízható mesterséges intelligencia észleléséhez. Független benchmarking és nagyszabású tesztelés igazolja az észlelési pontosságot. The AI detector model minimizes false positives and misclassifications, while benchmarks confirm consistent performance across multiple AI models.

A(z) CudekAI oktatók, hallgatók és kutatók megbíznak a tudományos intézményekben, főiskolákon és egyetemeken. Az iskolarendszer mesterséges intelligencia-detektort használ az esszék, a dolgozatok és a blogok tartalmának mesterséges intelligenciájának ellenőrzésére a pontos ellenőrzés érdekében.

A szövegírók, marketingszakemberek, toborzók, kiadók és szerzők az AI pontos észlelési pontszámára támaszkodnak. Minden beküldött tartalom elemzése megtörténik, hogy megbizonyosodjon arról, hogy a nagy téttel bíró tartalom megfelel az eredetiségi szabványoknak.

Legjobb ügynökségek számára

Credits: Tailored for You

AI detektor

Emberibbé

Plágium-ellenőrző

AI képérzékelő

Minden alkalmazás tartalmazza

Fordító

Tömeges MI-észlelést hajt végre API-integrációval tartalom bevitelével és API-hozzáférés megszerzésével az MI-érzékelőhöz az automatikus ellenőrzések érdekében. Az API támogatja a MI-észlelést, a plágiumellenőrzést, a parafráziskészítést és a fordítást.

Szerezzen API-hozzáférést még ma.

Az ingyenes Ai tartalomérzékelő eszköz 103 nyelven érhető el

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Cudekai mesterséges intelligencia detektora igazi stresszoldónak bizonyult. Néhány professzorom szigorú a mesterséges intelligencia által írt munkákkal kapcsolatban, és ez az eszköz bizalmat ad abban, hogy a dolgozataim hitelesnek tűnnek, mielőtt beadom őket.

Daniel

Miután befejeztem a dolgozataimat, Cudekai humanizer eszközét használom, hogy biztosan úgy hangzanak, mint én. Kisimítja az írást, és mindent természetesen folytat – olyan, mint a saját hangom, csak jobban kidolgozva.

Chelsea

Amikor elakadok valami átfogalmazásával, egyszerűen bedobom Cudekai átírójába. Másodpercek alatt tisztább, áttekinthetőbb verziókat kapok tőle, és rengeteg időt takarít meg más munkákra.

Ricardo

A Cudekai plágiumkeresője igazán alapos. A jelentések részletesek, de könnyen érthetőek, ami sokkal gyorsabbá teszi a problémák megoldását. Elengedhetetlen a projektjeimhez.

Michael