Хуманизатор с изкуствен интелект

Превърнете генерираните от изкуствен интелект текстове в писане, подобно на човек. Усъвършенстваното съдържание намалява разпознаваемостта, като същевременно запазва яснотата.

🎉 Вземете 7 месеца БЕЗПЛАТНО за всеки годишен план — без риск, анулирайте по всяко време

6

HR

0

MIN

0

SEC

Поддържани езици:

Bulgarian

English

French

Spanish

All others

1 Разходи за кредит

Режим на откриване

Основен

Предварително

Добавки по избор

Анализ на изреченията

Подробно откриване на ниво изречение

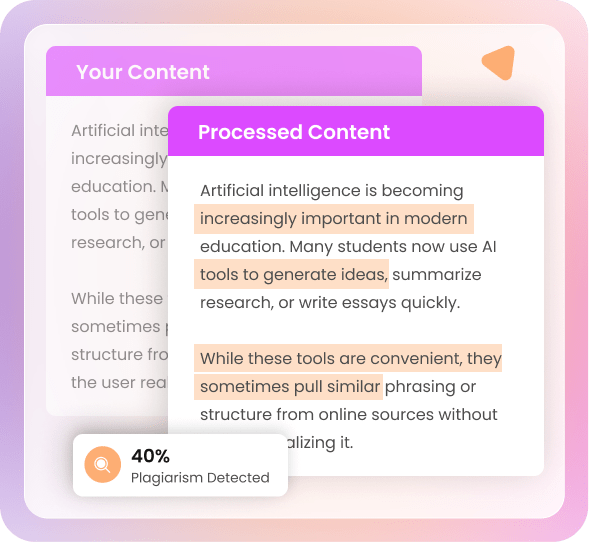

Проверка за плагиатство

Сканирайте копирания текст онлайн

Детектор на изображения с изкуствен интелект

Check if an image is AI-generated

AI Detector открива AI писмено съдържание с откриване на ниво абзац, откриване на ниво изречение и анализ на ниво дума. Той оценява AI речника, често използваните AI думи и прекалено използваните думи.

AI детекторът прилага откриване на ниво документ за сканиране на смесени документи, генерирани както от AI, така и от хора. CudekAI AI Checker проверява генерираните от AI модели с точни резултати.

AI Checker открива копирано съдържание, случайно плагиатство и дублирано съдържание. CudekAI детекторът за плагиатство сканира есета, статии, научни статии и уеб съдържание, за да провери оригиналността на съдържанието.

CudekAI съчетава откриване на AI и сканиране за плагиатство за пълен анализ на оригиналността.

Проверка за плагиатство с изкуствен интелектCudekAI Детекторът на изображения сканира визуални елементи, генерирани от AI. Той проверява автентичността на AI изображение в множество поддържани формати. AI Image Checker преглежда визуалното съдържание, за да оцени вероятността за AI.

Детекторът на изображения класифицира резултатите, като използва AI процент и визуален AI резултат, за да посочи ниски, средни или високи възможности за AI с ясен и структуриран анализ на изображението за точна проверка.

Детектор на изображения с изкуствен интелект

Превърнете генерираните от изкуствен интелект текстове в писане, подобно на човек. Усъвършенстваното съдържание намалява разпознаваемостта, като същевременно запазва яснотата.

Открива копирано съдържание и идентифицира случайно плагиатство чрез усъвършенствани алгоритми за откриване.

Идентифицирайте и коригирайте граматически, пунктуационни грешки и структура на изреченията. Подобрете четимостта с едно щракване.

Прегледайте тона, структурата и оценката за четимост, за да откриете пропуснати грешки преди изпращане.

Откриване на AI писмени текстове на английски, испански, френски, немски, японски, унгарски и други езици.

Превеждайте съдържание на 104 езика, като същевременно запазвате оригиналното намерение и контекст.

Проверява есетата за AI модели, плагиатство и структуриране. Подпомага справедливото оценяване.

Преобразувайте дълги документи в кратки резюмета. Фокусираното резюмиране поддържа информацията директна.

Пренапишете изреченията, за да подобрите яснотата и да избегнете повторения, без да губите ключовото намерение.

Преформулирайте изреченията и абзаците, използвайки синоними, за да подобрите четивността и плавността.

Поставете текст директно, за да започнете процеса на проверка. Въведете URL или качете DOCX, PDF, TXT или RTF файлове. CudekAI AI детекторът сканира до 15 000 знака.

Стартирайте проверката на AI, за да извършите анализ на ниво дума, ниво на изречение, ниво абзац и документ. AI детекторът автоматично сканира за генерирано от AI и плагиатствано съдържание.

Детекторът CudekAI ще сканира текста за секунди. Изтеглете подробния отчет във формат PDF и DOCX или създайте връзка за споделяне.

Откривайте AI съдържание, генерирано от най-добрите AI модели

Открива съдържание, генерирано от GPT-5, GPT-4, GPT-3, GPT-4.1 и GPT-4.1-Mini. Точното оценяване на вероятността с изкуствен интелект гарантира надежден анализ.

CudeKAI AI Checker открива текст от Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash и Gemini 2.5 Flash-Lite със структуриран анализ.

Идентифицирайте роботизиран текст от Клод Сонет 4 с помощта на анализ на ниво изречение и на ниво документ.

AI детекторът идентифицира езикови модели, произведени от Llama.

Открива текст, генериран от модели DeepSeek с адаптивен AI анализ на пръстови отпечатъци

Анализирайте съдържание, написано от AI, създадено от Grok с логика за сравнение на различни модели..

CudekAI използва модел с висока точност за надеждно AI откриване. Независимият бенчмаркинг и широкомащабното тестване потвърждават неговата точност на откриване. Моделът на AI детектор минимизира фалшивите положителни резултати и грешните класификации, докато бенчмарковете потвърждават последователна производителност в множество AI модели.

На CudekAI се доверяват преподаватели, студенти и изследователи в академични институции, колежи и университети. Училищната система използва AI детектор за проверка на AI в есета, доклади и съдържание на блогове за точна проверка.

Копирайтъри, търговци, специалисти по подбор на персонал, издатели и автори разчитат на прецизния му резултат за откриване на AI. Всяко изпращане се анализира, за да се гарантира, че съдържанието с високи залози отговаря на стандартите за оригиналност.

Най-добро за агенции

Credits: Tailored for You

AI детектор

Хуманизатор

Проверка за плагиатство

Детектор на изображения с изкуствен интелект

Всички приложения са включени

Преводач

Извършва масово AI откриване с API интеграция чрез въвеждане на съдържание и получаване на API достъп до AI детектора за автоматизирани проверки. API поддържа AI откриване, проверка за плагиатство, перифразиране и превод.

Вземете API достъп още днес.

Безплатният инструмент за детектор на съдържание с изкуствен интелект се предлага на 103 език

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

ИИ детекторът на Cudekai е истинско средство за облекчаване на стреса. Някои от моите преподаватели са стриктни относно работата, написана с изкуствен интелект, и този инструмент ми дава увереност, че документите ми изглеждат автентични, преди да ги предам.

Daniel

След като завърша документите си, използвам инструмента за хуманизиране на Cudekai, за да се уверя, че наистина звучат като мен. Той изглажда писането и кара всичко да тече естествено – като моя собствен глас, просто по-добре изпипан.

Chelsea

Винаги, когато се затруднявам да преформулирам нещо, просто го пускам в пренаписвача на Cudekai. Това ми дава по-чисти и ясни версии за секунди и ми спестява толкова много време за друга работа.

Ricardo

Проверката за плагиатство на Cudekai е наистина солидна. Докладите са подробни, но лесни за разбиране, което прави отстраняването на проблеми много по-бързо. Задължителна е за моите проекти.

Michael