Tekoälyn inhimillistäjä

Muunna tekoälyn luomat tekstit ihmisen kaltaiseksi kirjoitukseksi. Tarkistettu sisältö vähentää havaitsemista säilyttäen samalla selkeyden.

🎉 Saat 7 kuukautta ILMAISEKSI minkä tahansa vuositilauksen – ei riskiä, voit peruuttaa milloin tahansa

6

HR

0

MIN

0

SEC

Tuetut kielet:

Finnish

English

French

Spanish

All others

1 Luottokustannukset

Tunnistustila

Perus

Advance

Valinnaiset lisäosat

Lauseanalyysi

Yksityiskohtainen lausetason tunnistus

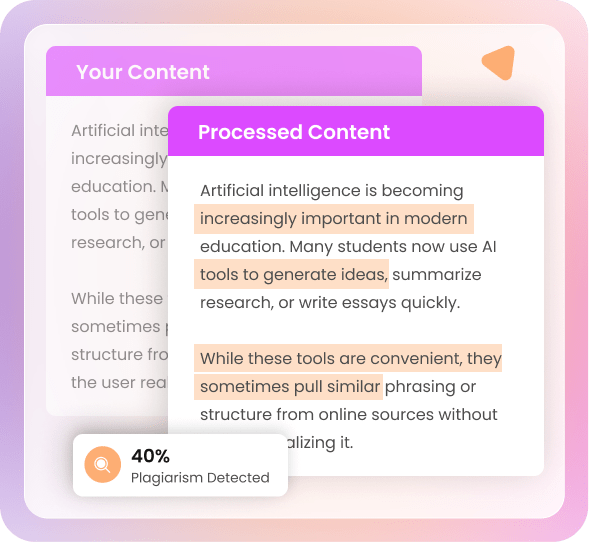

Plagioinnin tarkistus

Skannaa kopioitu teksti verkossa

Tekoälykuvan ilmaisin

Check if an image is AI-generated

Tekoälytunnistin tunnistaa tekoälyn avulla kirjoitettua sisältöä kappale-, lause- ja sanatason analyysin avulla. Se arvioi tekoälyn sanastoa, yleisesti käytettyjä tekoälysanoja ja liikaa käytettyjä sanoja.

Tekoälytunnistin käyttää asiakirjatason tunnistusta sekalaisten asiakirjojen skannaamiseen, sekä tekoälyn että ihmisen luomia. CudekAI AI Checker tarkistaa tekoälyn luomat mallit tarkoilla tuloksilla.

AI Checker havaitsee kopioidun sisällön, tahattoman plagioinnin ja päällekkäisen sisällön. CudekAI plagiointitunnistin skannaa esseitä, artikkeleita, tutkimuspapereita ja verkkosisältöä varmistaakseen sisällön alkuperäisyyden.

CudekAI yhdistää tekoälyn havaitsemisen ja plagiointitarkistuksen täydelliseen alkuperäisyysanalyysiin.

Tekoälyn plagioinnin tarkistusCudekAI Image Detector skannaa tekoälyn luomia kuvia. Se varmistaa tekoälykuvan aitouden useissa tuetuissa muodoissa. AI Image Checker tarkistaa visuaalisen sisällön määrittääkseen tekoälyn todennäköisyyden.

Kuvantunnistin luokittelee tulokset käyttämällä tekoälynopeutta ja visuaalista tekoälypistettä, mikä osoittaa alhaiset, keskisuuret tai korkeat tekoälymahdollisuudet sekä selkeän ja jäsennellyn kuva-analyysin tarkkuuden varmistamiseksi.

Tekoälykuvan ilmaisin

Muunna tekoälyn luomat tekstit ihmisen kaltaiseksi kirjoitukseksi. Tarkistettu sisältö vähentää havaitsemista säilyttäen samalla selkeyden.

Tunnistaa kopioidun sisällön ja vahingossa tapahtuvan plagioinnin edistyneiden tunnistusalgoritmien avulla.

Tunnista ja korjaa kielioppi-, välimerkki- ja lauserakennevirheet. Paranna luettavuutta yhdellä napsautuksella.

Tarkista sävy, rakenne ja luettavuuspisteet havaitaksesi huomaamattomat virheet ennen lähettämistä.

Havaitse tekoälyn kirjoittamaa tekstiä englanniksi, espanjaksi, ranskaksi, saksaksi, japaniksi, unkariksi ja muiksi kieliksi.

Käännä sisältöä 104 kielelle säilyttäen alkuperäisen tarkoituksen ja kontekstin.

Tarkista esseistä tekoälymallit, plagiointi ja jäsentely. Auttaa oikeudenmukaisessa arvostelussa.

Muunna pitkät asiakirjat tiiviiksi yhteenvedoiksi. Keskittynyt yhteenveto pitää tiedot yksinkertaisina.

Kirjoita lauseet uudelleen parantaaksesi selkeyttä ja välttääksesi toistoa menettämättä kuitenkaan keskeistä tarkoitusta.

Muotoile lauseet ja kappaleet uudelleen käyttämällä synonyymeja luettavuuden ja sujuvuuden parantamiseksi.

Liitä teksti suoraan aloittaaksesi tarkistusprosessin. Syötä URL-osoite tai lataa DOCX-, PDF-, TXT- tai RTF-tiedostoja. CudekAI Tekoälytunnistin skannaa jopa 15 000 merkkiä.

Suorita tekoälytarkistin suorittaaksesi sana-, lause-, kappale- ja asiakirjatason analyysin. Tekoälytunnistin etsii automaattisesti tekoälyn luomaa ja plagioitua sisältöä.

CudekAI-tunnistin skannaa tekstin sekunneissa. Lataa yksityiskohtainen raportti PDF- ja DOCX-muodossa tai luo jaettava linkki.

Tunnista parhaiden tekoälymallien tuottama tekoälysisältö

Tunnistaa GPT-5:n, GPT-4:n, GPT-3:n, GPT-4.1:n ja GPT-4.1-Minin tuottaman sisällön. Tarkka tekoälyn todennäköisyyspisteytys varmistaa luotettavan analyysin.

CudeKAI Tekoälytarkistin tunnistaa tekstin Gemini 3:ssa, Gemini 2.5 Prossa, Gemini 2.5 Flashissa ja Gemini 2.5 Flash-Litessa strukturoidun analyysin avulla.

Tunnista robottimainen teksti Claude Sonnet 4:stä lause- ja dokumenttitason analyysin avulla.

Tekoälyilmaisin tunnistaa laaman tuottamia kielellisiä malleja.

DeepSeek-mallien tuottaman tekstin tunnistaminen mukautuvalla tekoälyn sormenjälkianalyysillä

Analysoi Grokin luomaa tekoälyn kirjoittamaa sisältöä mallienvälisen vertailulogiikan avulla.

CudekAI käyttää erittäin tarkkaa mallia tekoälyn luotettavaan havaitsemiseen. Riippumaton vertailuanalyysi ja laajamittainen testaus varmistavat sen havaitsemistarkkuuden. Tekoälyn havaitsemismalli minimoi väärät positiiviset tulokset ja virheelliset luokittelut, ja vertailuanalyysit vahvistavat yhdenmukaisen suorituskyvyn useissa tekoälymalleissa.

Opettajat, opiskelijat ja tutkijat luottavat CudekAI-palveluun akateemisissa laitoksissa, korkeakouluissa ja yliopistoissa. Koulujärjestelmä käyttää tekoälytunnistinta tarkistaakseen tekoälyn esseissä, tutkielmissa ja blogisisällössä varmistaakseen sen tarkan varmuuden.

Copywriterit, markkinoijat, rekrytoijat, kustantajat ja kirjailijat luottavat sen tarkkaan tekoälyn tunnistuspisteytykseen. Jokainen lähetys analysoidaan sen varmistamiseksi, että tärkeä sisältö täyttää alkuperäisyysstandardit.

Paras toimistoille

Credits: Tailored for You

AI ilmaisin

Ihmisen luoja

Plagioinnin tarkistus

Tekoälykuvan ilmaisin

Kaikki sovellukset mukana

Kääntäjä

Suorittaa joukkotekoälytunnistuksen API-integraation avulla syöttämällä sisältöä ja saamalla API-käyttöoikeuden tekoälytunnistimeen automatisoituja tarkistuksia varten. API tukee tekoälyn tunnistusta, plagioinnin tarkistusta, parafrasointia ja käännöstä.

Hanki API-käyttöoikeus jo tänään.

Ilmainen Ai-sisällöntunnistustyökalu on saatavilla 103 kielellä

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Cudekai:n tekoälytunnistin on ollut todellinen stressinlievittäjä. Jotkut professoreistani ovat tiukkoja tekoälyn avulla kirjoitettujen töiden suhteen, ja tämä työkalu antaa minulle luottamusta siihen, että paperini näyttävät aidoilta ennen niiden palauttamista.

Daniel

Käytän Cudekai:n inhimillistämistyökalua tekstien viimeistelyn jälkeen varmistaakseni, että ne kuulostavat todella minulta. Se tasoittaa kirjoitusta ja saa kaiken soljumaan luonnollisesti – kuin oma ääneni, vain paremmin viimeisteltynä.

Chelsea

Aina kun joudun yrittämään muotoilla jotakin uudelleen, pudotan sen vain Cudekai:n uudelleenkirjoittajaan. Se antaa minulle siistimpiä ja selkeämpiä versioita sekunneissa ja säästää paljon aikaa muulle työlle.

Ricardo

Cudekai:n plagioinnintarkistus on todella luotettava. Raportit ovat yksityiskohtaisia mutta helppoja ymmärtää, mikä nopeuttaa ongelmien korjaamista huomattavasti. Se on välttämätön projekteissani.

Michael