AI Humanizer

แปลงข้อความที่สร้างโดย AI ให้เป็นลายมือที่เหมือนมนุษย์ เนื้อหาที่ปรับปรุงแล้วจะช่วยลดการตรวจจับในขณะที่ยังคงความชัดเจนไว้

🎉 รับฟรี 7 เดือนสำหรับแพ็คเกจรายปีใดก็ได้ — ไม่มีข้อผูกมัด ยกเลิกได้ทุกเมื่อ

6

HR

0

MIN

0

SEC

ภาษาที่รองรับ:

Thai

English

French

Spanish

All others

1 ต้นทุนเครดิต

โหมดการตรวจจับ

ขั้นพื้นฐาน

ก้าวหน้า

ส่วนเสริมเสริม

การวิเคราะห์ประโยค

การตรวจจับระดับประโยคโดยละเอียด

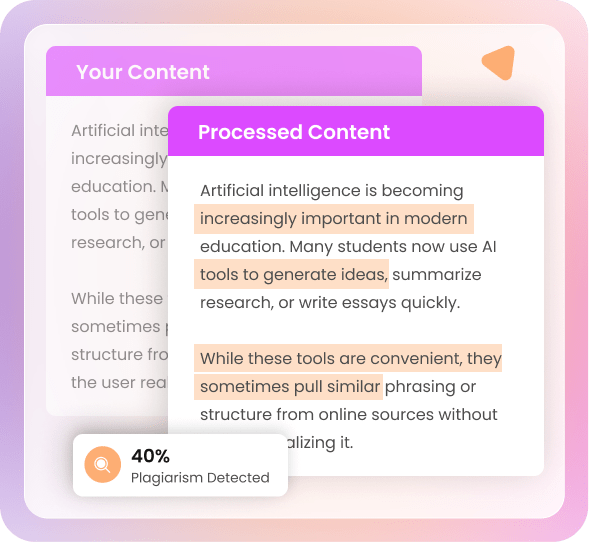

เครื่องตรวจสอบการลอกเลียนแบบ

สแกนข้อความที่คัดลอกทางออนไลน์

ตัวตรวจจับภาพ AI

Check if an image is AI-generated

ตัวตรวจจับ AI ตรวจจับเนื้อหาที่เขียนโดย AI ด้วยการตรวจจับระดับย่อหน้า การตรวจจับระดับประโยค และการวิเคราะห์ระดับคำ โดยจะประเมินคำศัพท์ AI, คำ AI ที่ใช้กันทั่วไป และคำที่ใช้มากเกินไป

AI Detector ใช้การตรวจจับระดับเอกสารเพื่อสแกนเอกสารแบบผสม ทั้งแบบ AI และที่มนุษย์สร้างขึ้น CudekAI AI Checker ตรวจสอบรูปแบบที่สร้างโดย AI ด้วยผลลัพธ์ที่แม่นยำ

AI Checker ตรวจจับเนื้อหาที่คัดลอก การลอกเลียนแบบโดยไม่ได้ตั้งใจ และเนื้อหาที่ซ้ำกัน เครื่องมือตรวจจับการลอกเลียนแบบ CudekAI จะสแกนเรียงความ บทความ เอกสารวิจัย และเนื้อหาเว็บเพื่อตรวจสอบความเป็นต้นฉบับของเนื้อหา

CudekAI ผสมผสานการตรวจจับ AI และการสแกนการลอกเลียนแบบเพื่อการวิเคราะห์ความเป็นต้นฉบับที่สมบูรณ์

โปรแกรมตรวจสอบการลอกเลียนแบบด้วย AICudekAI Image Detector สแกนภาพที่สร้างโดย AI ตรวจสอบความถูกต้องของภาพ AI ในรูปแบบที่รองรับหลายรูปแบบ AI Image Checker จะตรวจสอบเนื้อหาภาพเพื่อให้คะแนนความน่าจะเป็นของ AI

เครื่องตรวจจับภาพจัดประเภทผลลัพธ์โดยใช้อัตรา AI และคะแนน AI แบบมองเห็นเพื่อระบุความเป็นไปได้ของ AI ต่ำ กลาง หรือสูง พร้อมการวิเคราะห์ภาพที่ชัดเจนและมีโครงสร้างเพื่อการตรวจสอบที่แม่นยำ

ตัวตรวจจับภาพ AI

แปลงข้อความที่สร้างโดย AI ให้เป็นลายมือที่เหมือนมนุษย์ เนื้อหาที่ปรับปรุงแล้วจะช่วยลดการตรวจจับในขณะที่ยังคงความชัดเจนไว้

ตรวจจับเนื้อหาที่คัดลอกมาและระบุการลอกเลียนแบบโดยไม่ตั้งใจผ่านอัลกอริธึมการตรวจจับขั้นสูง

ตรวจสอบและแก้ไขไวยากรณ์ เครื่องหมายวรรคตอน และโครงสร้างประโยค ปรับปรุงความอ่านง่ายได้ในคลิกเดียว

ตรวจสอบน้ำเสียง โครงสร้าง และคะแนนความอ่านง่าย เพื่อตรวจหาข้อผิดพลาดที่อาจถูกมองข้ามก่อนส่งงาน

ตรวจจับการเขียนด้วย AI ในภาษาอังกฤษ สเปน ฝรั่งเศส เยอรมัน ญี่ปุ่น ฮังการี และอีกมากมาย

แปลเนื้อหาเป็น 104 ภาษา โดยคงไว้ซึ่งเจตนารมณ์และบริบทดั้งเดิม

ตรวจสอบเรียงความเพื่อหาแบบแผนที่ใช้ AI การลอกเลียนแบบ และโครงสร้าง ช่วยให้การให้คะแนนเป็นธรรม

แปลงเอกสารยาวๆ ให้เป็นบทสรุปที่กระชับ การสรุปที่ตรงประเด็นจะช่วยให้ข้อมูลเข้าใจง่าย

ปรับปรุงการเขียนประโยคเพื่อให้ชัดเจนยิ่งขึ้นและหลีกเลี่ยงการซ้ำซ้อน โดยไม่สูญเสียความหมายหลัก

เรียบเรียงประโยคและย่อหน้าใหม่โดยใช้คำพ้องความหมายเพื่อเพิ่มความอ่านง่ายและลื่นไหล

วางข้อความโดยตรงเพื่อเริ่มกระบวนการตรวจสอบ ป้อน URL หรืออัปโหลดไฟล์ DOCX, PDF, TXT หรือ RTF ตัวตรวจจับ AI ของ CudekAI สแกนได้สูงสุด 15000 ตัวอักษร

เรียกใช้โปรแกรมตรวจสอบ AI เพื่อวิเคราะห์ในระดับคำ ระดับประโยค ระดับย่อหน้า และระดับเอกสาร ตัวตรวจจับ AI จะสแกนหาเนื้อหาที่สร้างโดย AI และเนื้อหาที่ลอกเลียนแบบโดยอัตโนมัติ

เครื่องตรวจจับ CudekAI จะสแกนข้อความภายในไม่กี่วินาที ดาวน์โหลดรายงานโดยละเอียดในรูปแบบ PDF และ DOCX หรือสร้างลิงก์ที่สามารถแชร์ได้

ตรวจจับเนื้อหา AI ที่สร้างโดยโมเดล AI ชั้นนำ

ตรวจจับเนื้อหาที่สร้างโดย GPT-5, GPT-4, GPT-3, GPT-4.1 และ GPT-4.1-Mini การให้คะแนนความน่าจะเป็นด้วย AI ที่แม่นยำช่วยให้การวิเคราะห์น่าเชื่อถือ

CudeKAI AI Checker ตรวจจับข้อความโดยใช้ Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash และ Gemini 2.5 Flash-Lite ด้วยการวิเคราะห์เชิงโครงสร้าง

ระบุข้อความที่เขียนโดยหุ่นยนต์จากบทกวีซอนเน็ตบทที่ 4 ของโคลด โดยใช้การวิเคราะห์ระดับประโยคและระดับเอกสาร

ระบบตรวจจับ AI สามารถระบุรูปแบบทางภาษาที่เกิดจากลามะได้

ตรวจจับข้อความที่สร้างโดยโมเดล DeepSeek ด้วยการวิเคราะห์ลายนิ้วมือ AI แบบปรับตัวได้

วิเคราะห์เนื้อหาที่เขียนโดย AI ผ่าน Grok ด้วยตรรกะการเปรียบเทียบข้ามโมเดล

CudekAI ใช้โมเดลที่มีความแม่นยำสูงเพื่อการตรวจจับ AI ที่เชื่อถือได้ การเปรียบเทียบมาตรฐานอิสระและการทดสอบขนาดใหญ่ยืนยันความแม่นยำในการตรวจจับ โมเดลตรวจจับ AI ลดข้อผิดพลาดเชิงบวกและการจำแนกประเภทผิดพลาดให้น้อยที่สุด ในขณะที่การเปรียบเทียบมาตรฐานยืนยันประสิทธิภาพที่สม่ำเสมอในโมเดล AI หลายแบบ

CudekAI ได้รับความไว้วางใจจากครู นักเรียน และนักวิจัยในสถาบันการศึกษา วิทยาลัย และมหาวิทยาลัยต่างๆ ระบบโรงเรียนใช้ตัวตรวจจับ AI เพื่อตรวจสอบ AI ในเรียงความ รายงาน และเนื้อหาบล็อก เพื่อการตรวจสอบที่ถูกต้องแม่นยำ

นักเขียนคำโฆษณา นักการตลาด ผู้สรรหาบุคลากร สำนักพิมพ์ และนักเขียน ต่างไว้วางใจในคะแนนการตรวจจับ AI ที่แม่นยำของระบบนี้ ทุกผลงานที่ส่งเข้ามาจะได้รับการวิเคราะห์เพื่อให้มั่นใจว่าเนื้อหาที่มีความสำคัญสูงนั้นตรงตามมาตรฐานความเป็นต้นฉบับ

ดีที่สุดสำหรับเอเจนซี่

Credits: Tailored for You

เครื่องตรวจจับเอไอ

มนุษยนิยม

เครื่องตรวจสอบการลอกเลียนแบบ

ตัวตรวจจับภาพ AI

รวมแอพทั้งหมดแล้ว

นักแปล

ทำการตรวจสอบด้วย AI จำนวนมากโดยการผสานรวม API ด้วยการป้อนเนื้อหาและเข้าถึง API สำหรับตัวตรวจจับ AI เพื่อตรวจสอบโดยอัตโนมัติ API รองรับการตรวจจับด้วย AI การตรวจสอบการลอกเลียนแบบ การเรียบเรียงใหม่ และการแปล

รับสิทธิ์การเข้าถึง API ได้แล้ววันนี้

เครื่องมือตรวจจับเนื้อหา Ai ฟรีมีให้บริการในภาษา 103

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

โปรแกรมตรวจจับ AI ของ Cudekai ช่วยลดความเครียดได้มากจริงๆ อาจารย์บางท่านค่อนข้างเข้มงวดกับงานที่เขียนด้วย AI และเครื่องมือนี้ทำให้ฉันมั่นใจได้ว่างานเขียนของฉันดูเหมือนของจริงก่อนที่จะส่ง

Daniel

ฉันใช้เครื่องมือ Humanizer ของ Cudekai หลังจากเขียนรายงานเสร็จ เพื่อให้แน่ใจว่ารายงานเหล่านั้นฟังดูเหมือนตัวฉันเองจริงๆ มันช่วยทำให้การเขียนราบรื่นและไหลลื่นอย่างเป็นธรรมชาติ เหมือนกับน้ำเสียงของฉันเอง เพียงแต่ขัดเกลาให้ดียิ่งขึ้น

Chelsea

เมื่อไหร่ก็ตามที่ฉันติดขัดในการเรียบเรียงประโยคใหม่ ฉันก็จะใช้เครื่องมือเรียบเรียงประโยคของ Cudekai ทันที มันจะช่วยให้ฉันได้ประโยคที่สะอาดตาและชัดเจนขึ้นในเวลาไม่กี่วินาที และช่วยประหยัดเวลาให้ฉันไปทำงานอื่นได้มาก

Ricardo

โปรแกรมตรวจสอบการลอกเลียนแบบของ Cudekai นั้นยอดเยี่ยมมาก รายงานมีรายละเอียดแต่เข้าใจง่าย ทำให้แก้ไขปัญหาได้เร็วขึ้นมาก เป็นสิ่งที่ขาดไม่ได้สำหรับโปรเจกต์ของฉัน

Michael