Humanitzador d'IA

Converteix els textos generats per IA en escriptura semblant a la humana. El contingut refinat redueix la detecció alhora que manté la claredat.

🎉 Aconsegueix 7 mesos GRATIS en qualsevol pla anual, sense risc, cancel·la en qualsevol moment

6

HR

0

MIN

0

SEC

Idiomes admesos:

Catalan

English

French

Spanish

All others

1 Cost del crèdit

Mode de detecció

Bàsic

Avançar

Complements opcionals

Anàlisi de frases

Detecció detallada del nivell de frase

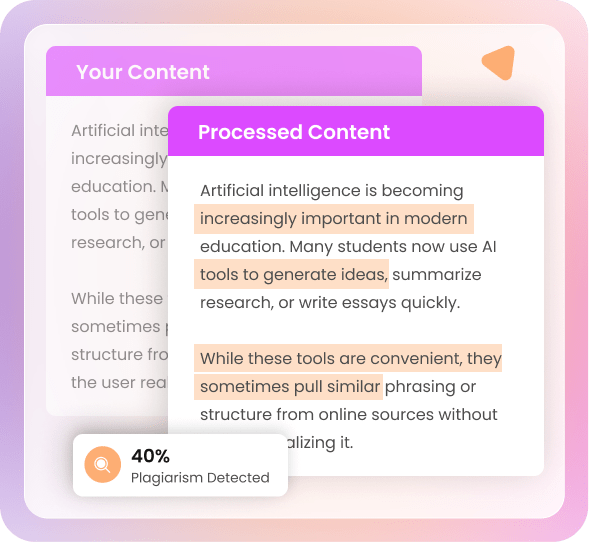

Comprovador de plagi

Escaneja el text copiat en línia

Detector d'imatges d'IA

Check if an image is AI-generated

AI Detector detecta contingut escrit amb IA amb detecció a nivell de paràgraf, detecció a nivell de frase i anàlisi a nivell de paraula. Avalua el vocabulari d'IA, les paraules d'IA d'ús habitual i les paraules utilitzades en excés.

El detector d'IA aplica la detecció a nivell de document per escanejar documents mixts, tant generats per IA com per humans. CudekAI AI Checker verifica els patrons generats per IA amb resultats precisos.

AI Checker detecta contingut copiat, plagi accidental i contingut duplicat. El detector de plagi CudekAI escaneja assaigs, articles, treballs de recerca i contingut web per verificar l'originalitat del contingut.

CudekAI combina la detecció d'IA i l'escaneig de plagi per a una anàlisi completa de l'originalitat.

Verificador de plagi d'IAEl detector d'imatges CudekAI escaneja elements visuals generats per IA. Verifica l'autenticitat de les imatges d'IA en diversos formats compatibles. El verificador d'imatges d'IA revisa el contingut visual per puntuar la probabilitat d'IA.

El detector d'imatges classifica els resultats mitjançant una taxa d'IA i una puntuació visual d'IA per indicar possibilitats d'IA baixes, mitjanes o altes amb una anàlisi d'imatges clara i estructurada per a una verificació precisa.

Detector d'imatges d'IA

Converteix els textos generats per IA en escriptura semblant a la humana. El contingut refinat redueix la detecció alhora que manté la claredat.

Detecta contingut copiat i identifica el plagi accidental mitjançant algoritmes de detecció avançats.

Identifica i corregeix la gramàtica, la puntuació i l'estructuració de les frases. Millora la llegibilitat amb un sol clic.

Reviseu el to, l'estructura i la puntuació de llegibilitat per detectar errors passats per alt abans de l'enviament.

Detecta l'escriptura d'IA en anglès, castellà, francès, alemany, japonès, hongarès i més.

Tradueix contingut a 104 idiomes mantenint la intenció i el context originals.

Revisa els assajos per detectar patrons d'IA, plagi i estructuració. Ajuda a qualificar correctament.

Convertiu documents llargs en resums concisos. El resum centrat manté la informació directa.

Reescriu les frases per millorar la claredat i evitar repeticions sense perdre la intenció clau.

Reformula frases i paràgrafs utilitzant sinònims per millorar la llegibilitat i la fluïdesa.

Enganxeu text directament per iniciar el procés de comprovació. Introduïu un URL o pengeu fitxers DOCX, PDF, TXT o RTF. CudekAI El detector d'IA escaneja fins a 15.000 caràcters.

Executeu el verificador d'IA per realitzar anàlisis a nivell de paraula, frase, paràgraf i document. El detector d'IA busca automàticament contingut generat per IA i plagiat.

El detector CudekAI escanejarà el text en segons. Descarrega l'informe detallat en format PDF i DOCX o crea un enllaç per compartir.

Detecteu el contingut d'IA generat pels millors models d'IA

Detecta contingut generat per GPT-5, GPT-4, GPT-3, GPT-4.1 i GPT-4.1-Mini. La puntuació de probabilitat d'IA precisa garanteix una anàlisi fiable.

CudeKAI AI Checker detecta text de Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash i Gemini 2.5 Flash-Lite amb anàlisi estructurada.

Identificar el text robotitzat de Claude Sonnet 4 mitjançant l'anàlisi a nivell de frase i a nivell de document.

El detector d'IA identifica els patrons lingüístics produïts per la llama.

Detecta el text generat pels models DeepSeek amb l'anàlisi d'empremtes digitals d'IA adaptativa

Analitzeu el contingut escrit amb IA creat per Grok amb la lògica de comparació entre models.

CudekAI utilitza un model d'alta precisió per a una detecció d'IA fiable. El benchmarking independent i les proves a gran escala verifiquen la seva precisió de detecció. El model de detector d'IA minimitza els falsos positius i les classificacions errònies, mentre que els punts de referència confirmen un rendiment consistent en diversos models d'IA.

Professors, estudiants i investigadors d'institucions acadèmiques, col·legis i universitats confien en CudekAI. El sistema escolar utilitza un detector d'IA per comprovar la intel·ligència artificial en assaigs, articles i contingut del bloc per a una verificació precisa.

Els redactors, els venedors, els reclutadors, els editors i els autors confien en la seva puntuació precisa de detecció d'IA. Cada enviament s'analitza per garantir que el contingut d'alt nivell compleix els estàndards d'originalitat.

El millor per a agències

Credits: Tailored for You

Detector d'IA

Humanitzador

Comprovador de plagi

Detector d'imatges d'IA

Totes les aplicacions incloses

Traductor

Realitza la detecció massiva d'IA amb la integració de l'API introduint contingut i obtenint accés de l'API al detector d'IA per a comprovacions automatitzades. L'API admet la detecció d'IA, la comprovació de plagi, la parafrasejada i la traducció.

Obtén accés a l'API avui mateix.

L'eina gratuïta de detector de contingut Ai està disponible en 103 idioma

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

El detector d'IA de Cudekai ha estat un autèntic alleujament de l'estrès. Alguns dels meus professors són estrictes amb els treballs escrits amb IA, i aquesta eina em dóna confiança que els meus treballs semblen autèntics abans de lliurar-los.

Daniel

Faig servir l'eina humanitzadora de Cudekai després d'acabar els meus treballs per assegurar-me que realment sonin com jo. Suavitza l'escriptura i fa que tot flueixi de manera natural, com la meva pròpia veu, només que més polida.

Chelsea

Sempre que em quedo encallat intentant reformular alguna cosa, simplement ho deixo anar al reescriptor de Cudekai. Em dóna versions més netes i clares en segons i m'estalvia molt de temps per a altres tasques.

Ricardo

El detector de plagi de Cudekai és realment sòlid. Els informes són detallats però fàcils d'entendre, cosa que fa que la resolució de problemes sigui molt més ràpida. És imprescindible per als meus projectes.

Michael