Humanizador de IA

Convierte textos generados por IA en texto con una calidad similar a la humana. El contenido refinado reduce la detección y mantiene la claridad.

🎉 Obtén 7 meses GRATIS en cualquier plan anual: sin riesgos, cancela en cualquier momento

6

HR

0

MIN

0

SEC

Idiomas admitidos:

Spanish

English

French

German

All others

1 Costo de crédito

Modo de detección

Básico

Avance

Complementos opcionales

Análisis de oraciones

Detección detallada del nivel de oración

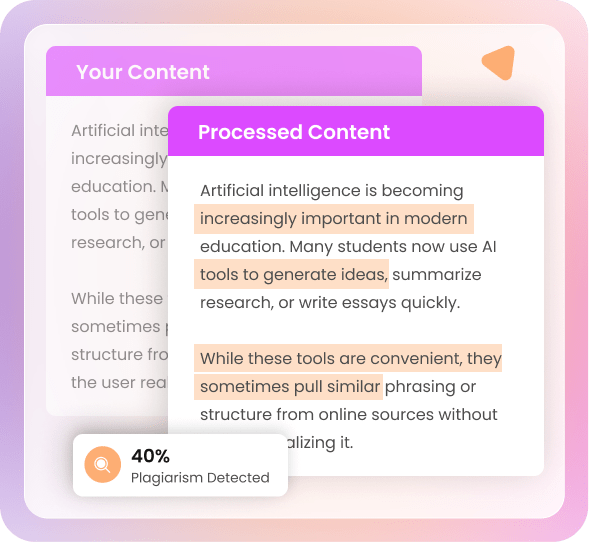

Comprobador de plagio

Escanear texto copiado en línea

Detector de imágenes con IA

Check if an image is AI-generated

AI Detector detecta contenido escrito por IA con detección a nivel de párrafo, detección a nivel de oración y análisis a nivel de palabra. Evalúa el vocabulario de IA, las palabras de IA de uso común y las palabras usadas en exceso.

El AI Detector aplica detección a nivel de documento para escanear documentos mixtos, tanto generados por IA como por humanos. CudekAI AI Checker verifica los patrones generados por IA con resultados precisos.

AI Checker detecta contenido copiado, plagio accidental y contenido duplicado. El detector de plagio CudekAI escanea ensayos, artículos, trabajos de investigación y contenido web para verificar la originalidad del contenido.

CudekAI combina la detección de IA y el escaneo de plagio para un análisis de originalidad completo.

Detector de plagio de IAEl Detector de Imágenes CudekAI escanea imágenes generadas por IA. Verifica la autenticidad de las imágenes en múltiples formatos compatibles. El Verificador de Imágenes con IA revisa el contenido visual para evaluar la probabilidad de IA.

El detector de imágenes clasifica los resultados utilizando una tasa de IA y una puntuación de IA visual para indicar posibilidades de IA bajas, medias o altas con un análisis de imagen claro y estructurado para una verificación precisa.

Detector de imágenes con IA

Convierte textos generados por IA en texto con una calidad similar a la humana. El contenido refinado reduce la detección y mantiene la claridad.

Detecta contenido copiado e identifica plagio accidental mediante algoritmos de detección avanzados.

Identifica y corrige la gramática, la puntuación y la estructura de oraciones. Mejora la legibilidad con un solo clic.

Revise el tono, la estructura y la puntuación de legibilidad para detectar errores pasados por alto antes de enviarlo.

Detecta escritura de IA en inglés, español, francés, alemán, japonés, húngaro y más.

Traduce contenido en 104 idiomas conservando la intención y el contexto originales.

Consulte los ensayos en busca de patrones de IA, plagio y estructuración. Ayuda en la calificación justa.

Convierta documentos extensos en resúmenes concisos. El resumen enfocado mantiene la información directa.

Vuelva a escribir oraciones para mejorar la claridad y evitar la repetición sin perder la intención clave.

Reformule oraciones y párrafos utilizando sinónimos para mejorar la legibilidad y la fluidez.

Pegue el texto directamente para iniciar el proceso de verificación. Ingrese una URL o cargue archivos DOCX, PDF, TXT o RTF. CudekAI El detector de IA escanea hasta 15000 caracteres.

Ejecute el verificador de IA para realizar análisis a nivel de palabra, oración, párrafo y documento. El detector de IA escanea automáticamente en busca de contenido plagiado y generado por IA.

El detector CudekAI escaneará el texto en segundos. Descargue el informe detallado en formato PDF y DOCX o cree un enlace para compartir.

Detecte contenido de IA generado por los mejores modelos de IA

Detecta contenido generado por GPT-5, GPT-4, GPT-3, GPT-4.1 y GPT-4.1-Mini. La puntuación precisa de probabilidad de IA garantiza un análisis confiable.

CudeKAI AI Checker detecta texto de Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash y Gemini 2.5 Flash-Lite con análisis estructurado.

Identifique texto robótico de Claude Sonnet 4 mediante análisis a nivel de oración y a nivel de documento.

El detector de IA identifica patrones lingüísticos producidos por llamas.

Detecta texto generado por modelos DeepSeek con análisis adaptativo de huellas dactilares de IA

Analice el contenido escrito por IA creado por Grok con lógica de comparación entre modelos.

CudekAI utiliza un modelo de alta precisión para una detección confiable de IA. La evaluación comparativa independiente y las pruebas a gran escala verifican su precisión de detección. El modelo de detector de IA minimiza los falsos positivos y las clasificaciones erróneas, mientras que los puntos de referencia confirman un rendimiento consistente en múltiples modelos de IA.

CudekAI cuenta con la confianza de profesores, estudiantes e investigadores de instituciones académicas, facultades y universidades. El sistema escolar utiliza un detector de IA para verificar la IA en ensayos, artículos y contenido de blogs para una verificación precisa.

Redactores, especialistas en marketing, reclutadores, editores y autores confían en su puntuación precisa de detección de IA. Cada envío se analiza para garantizar que el contenido de alto riesgo cumpla con los estándares de originalidad.

Ideal para agencias

Credits: Tailored for You

Detector de IA

Humanizador

Comprobador de plagio

Detector de imágenes con IA

Todas las aplicaciones incluidas

Traductor

Realiza detección masiva de IA con integración de API ingresando contenido y obteniendo acceso de API al detector de IA para verificaciones automatizadas. La API admite la detección de IA, la verificación de plagio, la paráfrasis y la traducción.

Obtenga acceso API hoy.

La herramienta de detección de contenido Ai gratuita está disponible en 103 idioma

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

El detector de IA de Cudekai me ha aliviado mucho el estrés. Algunos de mis profesores son muy estrictos con los trabajos escritos con IA, y esta herramienta me da la seguridad de que mis trabajos parecen auténticos antes de entregarlos.

Daniel

Después de terminar mis trabajos, uso la herramienta de humanización de Cudekai para asegurarme de que suenen como yo. Suaviza la escritura y hace que todo fluya con naturalidad, como mi propia voz, pero más pulida.

Chelsea

Cuando me quedo atascado intentando reformular algo, simplemente lo paso al reescritor de Cudekai. Me da versiones más limpias y claras en segundos y me ahorra muchísimo tiempo para otras tareas.

Ricardo

El detector de plagio de Cudekai es realmente sólido. Los informes son detallados pero fáciles de entender, lo que agiliza mucho la corrección de errores. Es indispensable para mis proyectos.

Michael