Humanizador de IA

Transforme textos gerados por IA em escrita semelhante à humana. O conteúdo refinado reduz a detecção, mantendo a clareza.

🎉 Ganhe 7 meses GRATUITOS em qualquer plano anual – sem risco, cancele a qualquer momento

6

HR

0

MIN

0

SEC

Idiomas suportados:

Portuguese

English

French

Spanish

All others

1 Custo de crédito

Modo de detecção

Básico

Avançar

Complementos opcionais

Análise de Frases

Detecção detalhada do nível de frase

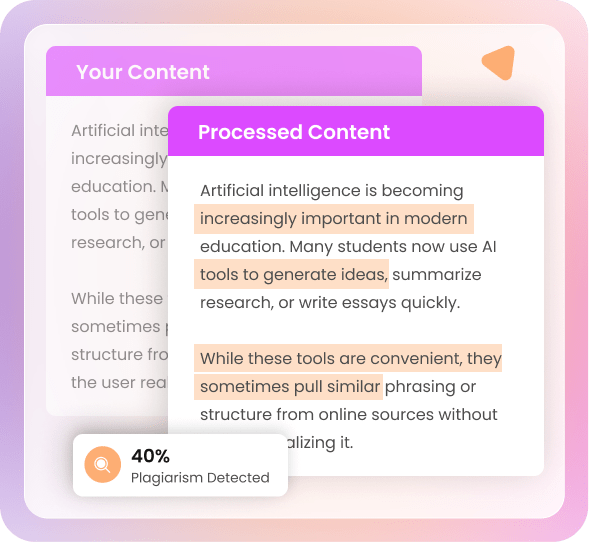

Verificador de plágio

Digitalize o texto copiado online

Detector de imagens por IA

Check if an image is AI-generated

O AI Detector detecta conteúdo escrito por IA com detecção em nível de parágrafo, detecção em nível de frase e análise em nível de palavra. Ele avalia o vocabulário de IA, palavras de IA comumente usadas e palavras usadas em excesso.

O AI Detector aplica detecção em nível de documento para digitalizar documentos mistos, tanto gerados por IA quanto por humanos. CudekAI O AI Checker verifica padrões gerados por IA com resultados precisos.

O AI Checker detecta conteúdo copiado, plágio acidental e conteúdo duplicado. O detector de plágio CudekAI verifica ensaios, artigos, trabalhos de pesquisa e conteúdo da web para verificar a originalidade do conteúdo.

CudekAI combina detecção de IA e verificação de plágio para uma análise completa de originalidade.

Verificador de plágio por IAO Detector de Imagens CudekAI analisa imagens geradas por IA. Ele verifica a autenticidade das imagens de IA em vários formatos suportados. O Verificador de Imagens de IA analisa o conteúdo visual para avaliar a probabilidade de IA.

O detector de imagem classifica os resultados usando uma taxa de IA e uma pontuação visual de IA para indicar possibilidades de IA baixa, média ou alta com análise de imagem clara e estruturada para verificação precisa.

Detector de imagens por IA

Transforme textos gerados por IA em escrita semelhante à humana. O conteúdo refinado reduz a detecção, mantendo a clareza.

Detecta conteúdo copiado e identifica plágio acidental por meio de algoritmos de detecção avançados.

Identifique e corrija erros de gramática, pontuação e estrutura de frases. Melhore a legibilidade com um clique.

Analise o tom, a estrutura e a pontuação de legibilidade para detectar erros que possam ter passado despercebidos antes da submissão.

Detecte escrita por IA em inglês, espanhol, francês, alemão, japonês, húngaro e outros idiomas.

Traduza conteúdo para 104 idiomas, mantendo a intenção e o contexto originais.

Verifica redações em busca de padrões de IA, plágio e estrutura. Auxilia na avaliação justa.

Converta documentos longos em resumos concisos. A sumarização objetiva mantém a informação direta e objetiva.

Reescreva as frases para melhorar a clareza e evitar repetições, sem perder a intenção principal.

Reescreva frases e parágrafos usando sinônimos para melhorar a legibilidade e a fluidez do texto.

Cole o texto diretamente para iniciar o processo de verificação. Insira um URL ou carregue arquivos DOCX, PDF, TXT ou RTF. O detector de IA CudekAI analisa até 15.000 caracteres.

Execute o verificador de IA para realizar análises em nível de palavra, frase, parágrafo e documento. O detector de IA verifica automaticamente conteúdo gerado por IA e conteúdo plagiado.

O detector CudekAI analisará o texto em segundos. Baixe o relatório detalhado em formato PDF e DOCX ou crie um link compartilhável.

Detectar conteúdo de IA gerado pelos principais modelos de IA

Detecta conteúdo gerado por GPT-5, GPT-4, GPT-3, GPT-4.1 e GPT-4.1-Mini. A pontuação de probabilidade precisa por IA garante uma análise confiável.

CudeKAI O verificador de IA detecta texto com Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash e Gemini 2.5 Flash-Lite com análise estruturada.

Identificação de texto robótico no Soneto 4 de Claude usando análise em nível de frase e em nível de documento.

O detector de IA identifica padrões linguísticos produzidos por lhamas.

Detecta texto gerado por modelos DeepSeek com análise adaptativa de impressões digitais de IA.

Analise o conteúdo gerado por IA pelo Grok com lógica de comparação entre modelos.

O CudekAI utiliza um modelo de alta precisão para detecção confiável por IA. Testes independentes e em larga escala comprovam sua precisão de detecção. O modelo de detecção por IA minimiza falsos positivos e classificações incorretas, enquanto os testes de desempenho confirmam um desempenho consistente em diversos modelos de IA.

O CudekAI é confiável para professores, alunos e pesquisadores em instituições acadêmicas, faculdades e universidades. O sistema escolar utiliza um detector de IA para verificar a presença de IA em redações, trabalhos e conteúdo de blogs, garantindo uma verificação precisa.

Redatores, profissionais de marketing, recrutadores, editores e autores confiam em sua precisa pontuação de detecção por IA. Cada envio é analisado para garantir que o conteúdo de alta relevância atenda aos padrões de originalidade.

Ideal para agências

Credits: Tailored for You

Detector de IA

Humanizador

Verificador de plágio

Detector de imagens por IA

Todos os aplicativos incluídos

Tradutor

Realiza detecção de IA em massa com integração de API, inserindo conteúdo e obtendo acesso à API do detector de IA para verificações automatizadas. A API oferece suporte à detecção de IA, verificação de plágio, paráfrase e tradução.

Obtenha acesso à API hoje mesmo.

A ferramenta gratuita de detecção de conteúdo AI está disponível em 103 idioma

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

O detector de IA do Cudekai tem sido um verdadeiro alívio. Alguns dos meus professores são rigorosos quanto a trabalhos escritos por IA, e essa ferramenta me dá a confiança de que meus trabalhos parecem autênticos antes de entregá-los.

Daniel

Eu uso a ferramenta de humanização do Cudekai depois de terminar meus textos para garantir que eles realmente soem como eu. Ela suaviza a escrita e faz com que tudo flua naturalmente — como minha própria voz, só que mais polida.

Chelsea

Sempre que tenho dificuldade em reformular algo, simplesmente uso o reescritor do Cudekai. Ele me fornece versões mais limpas e claras em segundos, economizando muito tempo para outras tarefas.

Ricardo

O verificador de plágio do Cudekai é realmente sólido. Os relatórios são detalhados, mas fáceis de entender, o que torna a correção de problemas muito mais rápida. É indispensável para os meus projetos.

Michael