Umanizator AI

Transformă textele generate de inteligență artificială în scriere asemănătoare omului. Conținutul rafinat reduce detectarea, menținând în același timp claritatea.

🎉 Primiți 7 luni GRATUIT pentru orice plan anual - fără riscuri, anulați oricând

6

HR

0

MIN

0

SEC

Limbi acceptate:

Romanian

English

French

Spanish

All others

1 Costul creditului

Mod de detectare

De bază

Avans

Suplimente opționale

Analiza propozițiilor

Detectare detaliată la nivel de propoziție

Verificator de plagiat

Scanați textul copiat online

Detector de imagini AI

Check if an image is AI-generated

AI Detector detectează conținutul scris AI cu detectarea la nivel de paragraf, detectarea la nivel de propoziție și analiza la nivel de cuvânt. Evaluează vocabularul AI, cuvintele AI utilizate în mod obișnuit și cuvintele suprautilizate.

Detectorul AI aplică detectarea la nivel de document pentru a scana documente mixte, atât generate de IA, cât și de oameni. CudekAI AI Checker verifică modelele generate de AI cu rezultate precise.

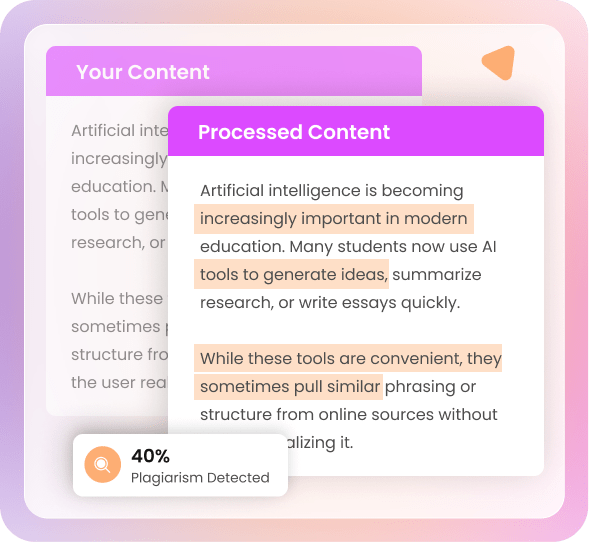

AI Checker detectează conținutul copiat, plagiatul accidental și conținutul duplicat. CudekAI detector de plagiat scanează eseuri, articole, lucrări de cercetare și conținut web pentru a verifica originalitatea conținutului.

CudekAI combină detectarea AI și scanarea plagiatului pentru o analiză completă a originalității.

Verificator de plagiat AICudekAI Image Detector scanează imagini generate de AI. Verifică autenticitatea imaginii AI în mai multe formate acceptate. AI Image Checker analizează conținutul vizual pentru a nota probabilitatea AI.

Detectorul de imagine clasifică rezultatele utilizând o rată AI și un scor vizual AI pentru a indica posibilități AI scăzute, medii sau mari, cu analiză clară și structurată a imaginii pentru o verificare precisă.

Detector de imagini AI

Transformă textele generate de inteligență artificială în scriere asemănătoare omului. Conținutul rafinat reduce detectarea, menținând în același timp claritatea.

Detectează conținutul copiat și identifică plagiatul accidental prin algoritmi avansati de detectare.

Identificați și remediați gramatica, punctuația și structurarea propozițiilor. Îmbunătățiți lizibilitatea cu un singur clic.

Examinați tonul, structura și scorul de lizibilitate pentru a detecta greșelile trecute cu vederea înainte de trimitere.

Detectează scrisul AI în engleză, spaniolă, franceză, germană, japoneză, maghiară și multe altele.

Traduceți conținut în 104 limbi, păstrând intenția și contextul original.

Verifică eseurile pentru tipare de inteligență artificială, plagiat și structurare. Ajută la o notare corectă.

Transformați documentele lungi în rezumate concise. Rezumatul concentrat menține informațiile directe.

Rescrieți propozițiile pentru a îmbunătăți claritatea și a evita repetițiile fără a pierde intenția cheie.

Reformulați propozițiile și paragrafele folosind sinonime pentru a îmbunătăți lizibilitatea și fluiditatea.

Lipiți textul direct pentru a începe procesul de verificare. Introduceți o adresă URL sau încărcați fișiere DOCX, PDF, TXT sau RTF. Detectorul de inteligență artificială CudekAI scanează până la 15000 de caractere.

Rulați verificatorul de inteligență artificială pentru a efectua analize la nivel de cuvânt, propoziție, paragraf și document. Detectorul de inteligență artificială scanează automat conținutul generat de inteligență artificială și cel plagiat.

Detectorul CudekAI va scana textul în câteva secunde. Descărcați raportul detaliat în format PDF și DOCX sau creați un link partajabil.

Detectează conținutul AI generat de modelele de AI de top

Detectează conținutul generat de GPT-5, GPT-4, GPT-3, GPT-4.1 și GPT-4.1-Mini. Scorul precis al probabilității prin inteligență artificială asigură o analiză fiabilă.

CudeKAI Verificatorul de inteligență artificială detectează textul din Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash și Gemini 2.5 Flash-Lite cu analiză structurată.

Identificați textul robotizat din Sonetul 4 al lui Claude folosind analiza la nivel de propoziție și la nivel de document.

Detectorul de inteligență artificială identifică tiparele lingvistice produse de lame.

Detectează textul generat de modelele DeepSeek cu ajutorul analizei adaptive a amprentelor digitale prin inteligență artificială

Analizați conținutul scris cu inteligență artificială creat de Grok cu ajutorul logicii de comparare între modele.

CudekAI folosește un model de înaltă precizie pentru o detectare fiabilă prin inteligență artificială. Analize comparative independente și teste la scară largă verifică acuratețea detectării sale. Modelul detectorului de inteligență artificială minimizează rezultatele fals pozitive și clasificările greșite, în timp ce analizele comparative confirmă performanța consistentă în mai multe modele de inteligență artificială.

CudekAI este o companie de încredere pentru profesorii, studenții și cercetătorii din instituțiile academice, colegiile și universitățile. Sistemul școlar folosește un detector de inteligență artificială pentru a verifica prezența inteligenței artificiale în eseuri, lucrări și conținutul blogurilor, pentru o verificare precisă.

Copywriteri, marketeri, recrutori, editori și autori se bazează pe scorul său precis de detectare a inteligenței artificiale. Fiecare trimitere este analizată pentru a se asigura că un conținut de mare importanță îndeplinește standardele de originalitate.

Cel mai bun pentru agenții

Credits: Tailored for You

Detector AI

Umanizator

Verificator de plagiat

Detector de imagini AI

Toate aplicațiile incluse

Traducător

Efectuează detectarea în masă a inteligenței artificiale cu integrare API prin introducerea de conținut și obținerea accesului API la detectorul de inteligență artificială pentru verificări automate. API-ul acceptă detectarea inteligenței artificiale, verificarea plagiatului, parafrazarea și traducerea.

Obțineți acces API astăzi.

Instrumentul gratuit de detectare a conținutului Ai este disponibil în limba 103

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Detectorul de inteligență artificială al lui Cudekai a fost o adevărată modalitate de a-mi ameliora stresul. Unii dintre profesorii mei sunt stricți în ceea ce privește lucrările scrise cu ajutorul inteligenței artificiale, iar acest instrument îmi dă încredere că lucrările mele arată autentic înainte de a le preda.

Daniel

Folosesc instrumentul umanizator al lui Cudekai după ce termin lucrările pentru a mă asigura că sună într-adevăr ca mine. Netezește textul și face ca totul să curgă natural - ca propria mea voce, doar mai șlefuită.

Chelsea

Ori de câte ori mă blochez încercând să reformulez ceva, pur și simplu îl pun în rewriter-ul Cudekai. Îmi oferă versiuni mai curate și mai clare în câteva secunde și îmi economisește mult timp pentru alte sarcini.

Ricardo

Verificatorul de plagiat al lui Cudekai este foarte bun. Rapoartele sunt detaliate, dar ușor de înțeles, ceea ce face ca remedierea problemelor să fie mult mai rapidă. Este un instrument indispensabil pentru proiectele mele.

Michael