AI-humaniserare

Förvandla AI-genererade texter till mänskliga texter. Förfinat innehåll minskar upptäckten samtidigt som klarheten bibehålls.

🎉 Få 7 månader GRATIS på valfri årsplan — ingen risk, avbryt när som helst

6

HR

0

MIN

0

SEC

Språk som stöds:

Swedish

English

French

Spanish

All others

1 Kreditkostnad

Detektionsläge

Grundläggande

Förskott

Valfria tillägg

Meningsanalys

Detaljerad detektering av meningsnivå

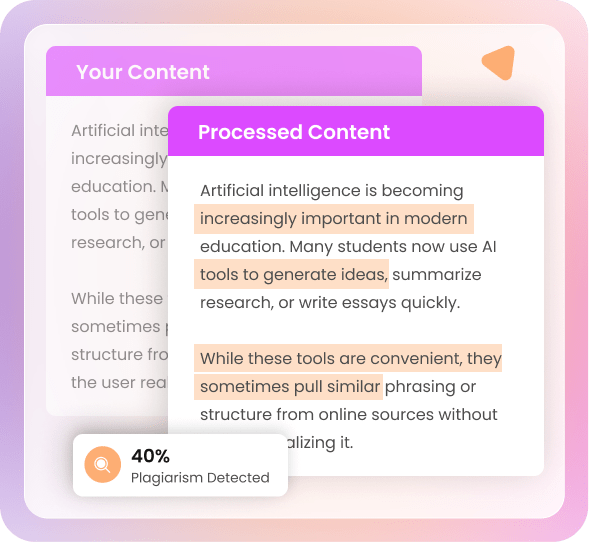

Plagiatkontroll

Skanna kopierad text online

AI-bilddetektor

Check if an image is AI-generated

AI Detector upptäcker skrivet innehåll med hjälp av AI med hjälp av stycke-, menings- och ordnivåanalys. Den utvärderar AI-vokabulär, vanliga AI-ord och överanvända ord.

AI-detektorn tillämpar dokumentnivådetektering för att skanna blandade dokument, både AI-genererade och mänskligt genererade. CudekAI AI Checker verifierar AI-genererade mönster med korrekta resultat.

AI Checker upptäcker kopierat innehåll, oavsiktlig plagiering och duplicerat innehåll. CudekAI plagiatdetektor skannar essäer, artiklar, forskningsrapporter och webbinnehåll för att verifiera innehållets originalitet.

CudekAI kombinerar AI-detektering och plagiatskanning för en komplett originalitetsanalys.

AI-plagiatkontrollCudekAI Bilddetektor skannar AI-genererade bilder. Den verifierar AI-bildernas äkthet i flera format som stöds. AI-bildkontrollen granskar visuellt innehåll för att bedöma AI-sannolikheten.

Bilddetektorn klassificerar resultat med hjälp av en AI-hastighet och en visuell AI-poäng för att indikera låga, medelhöga eller höga AI-möjligheter med tydlig och strukturerad bildanalys för noggrann verifiering.

AI-bilddetektor

Förvandla AI-genererade texter till mänskliga texter. Förfinat innehåll minskar upptäckten samtidigt som klarheten bibehålls.

Upptäcker kopierat innehåll och identifierar oavsiktligt plagiat genom avancerade detekteringsalgoritmer.

Identifiera och fixa grammatik, skiljetecken och meningsstrukturering. Förbättra läsbarheten med ett klick.

Granska ton, struktur och läsbarhetspoäng för att upptäcka förbisedda misstag innan du skickar in.

Upptäck AI-skrivning på engelska, spanska, franska, tyska, japanska, ungerska och mer.

Översätt innehåll över 104 språk samtidigt som du behåller ursprungliga avsikter och sammanhang.

Kontrollera uppsatser för AI-mönster, plagiat och strukturering. Hjälper till med rättvisa betyg.

Konvertera långa dokument till kortfattade sammanfattningar. Fokuserad sammanfattning håller informationen direkt.

Skriv om meningar för att förbättra klarheten och undvika upprepningar utan att förlora viktiga avsikter.

Omformulera meningar och stycken med synonymer för att förbättra läsbarheten och flödet.

Klistra in text direkt för att starta kontrollprocessen. Ange en URL eller ladda upp DOCX-, PDF-, TXT- eller RTF-filer. CudekAI AI-detektor skannar upp till 15 000 tecken.

Kör AI-kontrollen för att utföra analyser på ordnivå, meningsnivå, styckenivå och dokumentnivå. AI-detektorn söker automatiskt efter AI-genererat och plagierat innehåll.

CudekAI-detektorn skannar texten på några sekunder. Ladda ner den detaljerade rapporten i PDF- och DOCX-format eller skapa en delbar länk.

Upptäck AI-innehåll genererat av de bästa AI-modellerna

Upptäcker innehåll som genereras av GPT-5, GPT-4, GPT-3, GPT-4.1 och GPT-4.1-Mini. Exakt AI-sannolikhetspoäng säkerställer tillförlitlig analys.

CudeKAI AI Checker upptäcker text från Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash och Gemini 2.5 Flash-Lite med strukturerad analys.

Identifiera robottext från Claude Sonnet 4 med hjälp av analys på meningsnivå och på dokumentnivå.

AI-detektorn identifierar språkliga mönster producerade av lama.

Upptäcker text som genereras av DeepSeek-modeller med adaptiv AI-fingeravtrycksanalys

Analysera AI-skrivet innehåll skapat av Grok med jämförelselogik mellan olika modeller.

CudekAI använder en modell med hög noggrannhet för tillförlitlig AI-detektion. Oberoende benchmarking och storskalig testning verifierar dess detektionsnoggrannhet. AI-detektormodellen minimerar falska positiva och felaktiga klassificeringar, medan benchmarks bekräftar konsekvent prestanda över flera AI-modeller.

CudekAI är betrott av lärare, studenter och forskare vid akademiska institutioner, högskolor och universitet. Skolsystemet använder en AI-detektor för att kontrollera AI i uppsatser, artiklar och blogginnehåll för korrekt verifiering.

Copywriters, marknadsförare, rekryterare, utgivare och författare förlitar sig på dess exakta AI-detekteringspoäng. Varje bidrag analyseras för att säkerställa att innehåll med höga insatser uppfyller originalitetsstandarder.

Bäst för byråer

Credits: Tailored for You

AI-detektor

Humaniserare

Plagiatkontroll

AI-bilddetektor

Alla appar ingår

Översättare

Utför AI-bulkdetektering med API-integration genom att mata in innehåll och få API-åtkomst till AI-detektorn för automatiserade kontroller. API:et stöder AI-detektering, plagiatkontroll, parafrasering och översättning.

Få API-åtkomst idag.

Gratis Ai-innehållsdetektorverktyg är tillgängligt på språket 103

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Cudekais AI-detektor har verkligen hjälpt mig att lindra stress. Några av mina professorer är strikta när det gäller AI-skrivna arbeten, och det här verktyget ger mig förtroende för att mina uppsatser ser autentiska ut innan jag lämnar in dem.

Daniel

Jag använder Cudekais humaniseringsverktyg efter att jag har skrivit klart mina uppsatser för att se till att de faktiskt låter som jag. Det jämnar ut texten och får allt att flyta naturligt – som min egen röst, bara mer polerad.

Chelsea

När jag har fastnat och försöker omformulera något, lägger jag det bara i Cudekais omskrivningsprogram. Det ger mig renare, tydligare versioner på några sekunder och sparar mig så mycket tid för annat arbete.

Ricardo

Cudekais plagiatkontroll är riktigt bra. Rapporterna är detaljerade men lätta att förstå, vilket gör det mycket snabbare att åtgärda problem. Det är ett måste för mina projekt.

Michael