AI-humanizer

Zet door AI gegenereerde teksten om in menselijk geschreven teksten. Verfijnde inhoud vermindert de kans op detectie, terwijl de leesbaarheid behouden blijft.

🎉 Krijg 7 maanden GRATIS bij elk jaarabonnement — geen risico, annuleer op elk moment

6

HR

0

MIN

0

SEC

Ondersteunde talen:

Dutch

English

French

Spanish

All others

1 Kredietkosten

Detectiemodus

Basis

Voorschot

Optionele add-ons

Zinsanalyse

Gedetailleerde detectie van zinsniveau

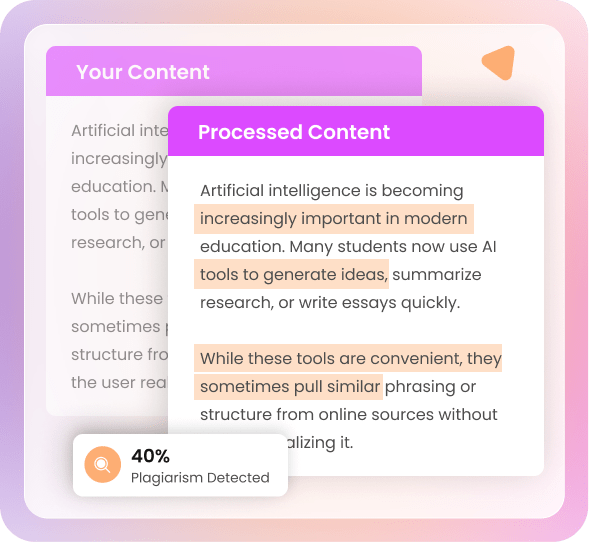

Plagiaatcontrole

Gekopieerde tekst online scannen

AI-beelddetector

Check if an image is AI-generated

AI Detector detecteert door AI geschreven content met behulp van analyse op alinea-, zins- en woordniveau. Het evalueert de AI-woordenschat, veelgebruikte AI-woorden en overmatig gebruikte woorden.

De AI-detector past detectie op documentniveau toe om gemengde documenten te scannen, zowel door AI als door mensen gegenereerde documenten. De AI-checker verifieert door AI gegenereerde patronen met nauwkeurige resultaten.

AI Checker detecteert gekopieerde inhoud, onbedoeld plagiaat en dubbele inhoud. De plagiaatdetector van CudekAI scant essays, artikelen, onderzoeksrapporten en webinhoud om de originaliteit van de inhoud te controleren.

CudekAI combineert AI-detectie en plagiaatscanning voor een complete originaliteitsanalyse.

AI-plagiaatcheckerCudekAI De beelddetector scant door AI gegenereerde beelden. Het verifieert de authenticiteit van AI-beelden in meerdere ondersteunde formaten. De AI-beeldchecker beoordeelt de visuele inhoud om de waarschijnlijkheid van AI-gebruik te bepalen.

De beelddetector classificeert resultaten aan de hand van een AI-percentage en een visuele AI-score om lage, gemiddelde of hoge AI-mogelijkheden aan te geven, met een duidelijke en gestructureerde beeldanalyse voor nauwkeurige verificatie.

AI-beelddetector

Zet door AI gegenereerde teksten om in menselijk geschreven teksten. Verfijnde inhoud vermindert de kans op detectie, terwijl de leesbaarheid behouden blijft.

Detecteert gekopieerde inhoud en identificeert onbedoeld plagiaat door middel van geavanceerde detectiealgoritmen.

Identificeer en corrigeer grammatica-, interpunctie- en zinsbouwfouten. Verbeter de leesbaarheid met één klik.

Controleer de toon, structuur en leesbaarheid om eventuele fouten die over het hoofd zijn gezien op te sporen vóór indiening.

Detecteer AI-teksten in het Engels, Spaans, Frans, Duits, Japans, Hongaars en meer.

Vertaal content in 104 talen met behoud van de oorspronkelijke bedoeling en context.

Controleer essays op AI-patronen, plagiaat en structuur. Draagt bij aan een eerlijke beoordeling.

Zet lange documenten om in beknopte samenvattingen. Gerichte samenvattingen houden de informatie overzichtelijk.

Herschrijf zinnen om de duidelijkheid te verbeteren en herhaling te vermijden, zonder de kernboodschap te verliezen.

Herschrijf zinnen en alinea's met behulp van synoniemen om de leesbaarheid en de samenhang te verbeteren.

Plak de tekst direct om het controleproces te starten. Voer een URL in of upload DOCX-, PDF-, TXT- of RTF-bestanden. CudekAI De AI-detector scant tot 15.000 tekens.

Gebruik de AI-checker om analyses uit te voeren op woord-, zins-, alinea- en documentniveau. De AI-detector scant automatisch op door AI gegenereerde en geplagieerde inhoud.

De CudekAI-detector scant de tekst binnen enkele seconden. Download het gedetailleerde rapport in PDF- en DOCX-formaat of maak een deelbare link aan.

Detecteer AI-content gegenereerd door de beste AI-modellen.

Detecteert content gegenereerd door GPT-5, GPT-4, GPT-3, GPT-4.1 en GPT-4.1-Mini. Nauwkeurige AI-waarschijnlijkheidsscores zorgen voor een betrouwbare analyse.

CudeKAI AI Checker detecteert tekst van Gemini 3, Gemini 2.5 Pro, Gemini 2.5 Flash en Gemini 2.5 Flash-Lite met gestructureerde analyse.

Identificeer robotachtige tekst in Claude Sonnet 4 met behulp van analyse op zins- en documentniveau.

De AI-detector identificeert taalpatronen die door lama's worden geproduceerd.

Detecteert tekst gegenereerd door DeepSeek-modellen met behulp van adaptieve AI-vingerafdrukanalyse.

Analyseer AI-geschreven content van Grok met behulp van vergelijkingslogica tussen verschillende modellen.

CudekAI maakt gebruik van een zeer nauwkeurig model voor betrouwbare AI-detectie. Onafhankelijke benchmarks en grootschalige tests bevestigen de nauwkeurigheid van de detectie. Het AI-detectiemodel minimaliseert valse positieven en verkeerde classificaties, terwijl benchmarks de consistente prestaties van meerdere AI-modellen bevestigen.

CudekAI wordt vertrouwd door docenten, studenten en onderzoekers van academische instellingen, hogescholen en universiteiten. Het schoolsysteem gebruikt een AI-detector om AI in essays, papers en bloginhoud te controleren op nauwkeurige verificatie.

Copywriters, marketeers, recruiters, uitgevers en auteurs vertrouwen op de nauwkeurige AI-detectiescore. Elke inzending wordt geanalyseerd om ervoor te zorgen dat de inhoud met een hoge inzet voldoet aan de originaliteitsnormen.

Het beste voor agentschappen

Credits: Tailored for You

AI-detector

Humaniseerder

Plagiaatcontrole

AI-beelddetector

Alle apps inbegrepen

Vertaler

Voert bulk-AI-detectie uit met API-integratie door inhoud in te voeren en API-toegang tot de AI-detector te krijgen voor geautomatiseerde controles. De API ondersteunt AI-detectie, plagiaatcontrole, parafrasering en vertaling.

Krijg vandaag nog API-toegang.

Gratis Ai-inhoudsdetectietool is beschikbaar in 103 taal

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

De AI-detector van Cudekai is echt een verademing. Sommige van mijn professoren zijn erg streng wat betreft door AI geschreven werk, en deze tool geeft me het vertrouwen dat mijn papers er authentiek uitzien voordat ik ze inlever.

Daniel

Ik gebruik de 'humanizer'-tool van Cudekai nadat ik mijn papers heb afgerond, om ervoor te zorgen dat ze echt klinken zoals ik ze schrijf. Het maakt de tekst vloeiender en zorgt ervoor dat alles natuurlijk klinkt – net als mijn eigen stem, maar dan beter gepolijst.

Chelsea

Als ik vastloop bij het herschrijven van iets, stop ik het gewoon in de herschrijffunctie van Cudekai. Die levert me binnen enkele seconden een schonere, duidelijkere versie op en bespaart me zoveel tijd voor ander werk.

Ricardo

De plagiaatchecker van Cudekai is echt heel goed. De rapporten zijn gedetailleerd maar makkelijk te begrijpen, waardoor het oplossen van problemen veel sneller gaat. Het is een onmisbaar hulpmiddel voor mijn projecten.

Michael