एआई ह्यूमनाइज़र

कृत्रिम बुद्धिमत्ता से उत्पन्न पाठों को मानवीय लेखन के समान बनाएं। परिष्कृत सामग्री स्पष्टता बनाए रखते हुए पहचान की संभावना को कम करती है।

🎉 किसी भी वार्षिक योजना पर 7 महीने मुफ़्त पाएं - कोई जोखिम नहीं, कभी भी रद्द करें

6

HR

0

MIN

0

SEC

समर्थित भाषाएँ:

Hindi

English

French

Spanish

All others

1 क्रेडिट लागत

पता लगाने का तरीका

बुनियादी

अग्रिम

वैकल्पिक ऐड-ऑन

वाक्य विश्लेषण

विस्तृत वाक्य स्तर का पता लगाना

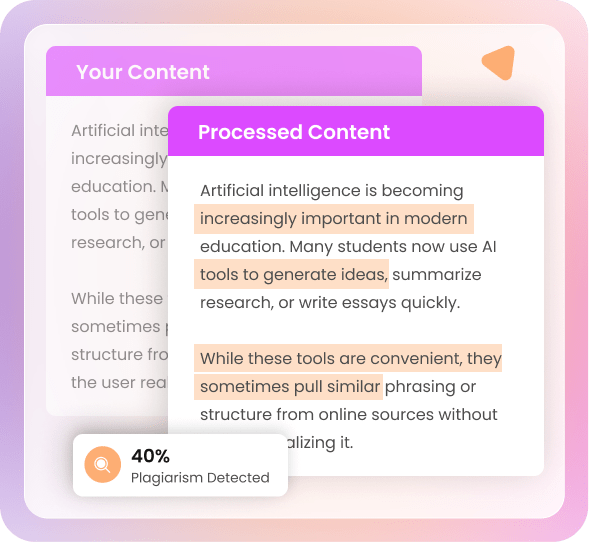

साहित्यिक चोरी जाँचकर्ता

कॉपी किए गए टेक्स्ट को ऑनलाइन स्कैन करें

एआई इमेज डिटेक्टर

Check if an image is AI-generated

एआई डिटेक्टर पैराग्राफ-स्तर, वाक्य-स्तर और शब्द-स्तर के विश्लेषण के माध्यम से एआई द्वारा लिखित सामग्री का पता लगाता है। यह एआई शब्दावली, आमतौर पर इस्तेमाल होने वाले एआई शब्दों और अति प्रयोग किए गए शब्दों का मूल्यांकन करता है।

एआई डिटेक्टर मिश्रित दस्तावेज़ों को स्कैन करने के लिए दस्तावेज़-स्तरीय पहचान का उपयोग करता है, चाहे वे एआई द्वारा निर्मित हों या मानव द्वारा। एआई चेकर सटीक परिणामों के साथ एआई द्वारा निर्मित पैटर्न को सत्यापित करता है।

एआई चेकर नकल की गई सामग्री, अनजाने में हुई साहित्यिक चोरी और डुप्लिकेट सामग्री का पता लगाता है। CudekAI साहित्यिक चोरी डिटेक्टर निबंधों, लेखों, शोध पत्रों और वेब सामग्री को स्कैन करके सामग्री की मौलिकता को सत्यापित करता है।

CudekAI मौलिकता के संपूर्ण विश्लेषण के लिए एआई डिटेक्शन और साहित्यिक चोरी स्कैनिंग को संयोजित करता है।

एआई साहित्यिक चोरी जाँचकर्ताCudekAI इमेज डिटेक्टर एआई द्वारा जनरेट किए गए विज़ुअल को स्कैन करता है। यह कई समर्थित फॉर्मेट में एआई इमेज की प्रामाणिकता को सत्यापित करता है। एआई इमेज चेकर, एआई की संभावना का स्कोर निर्धारित करने के लिए विज़ुअल कंटेंट की समीक्षा करता है।

इमेज डिटेक्टर सटीक सत्यापन के लिए स्पष्ट और संरचित छवि विश्लेषण के साथ कम, मध्यम या उच्च एआई संभावनाओं को इंगित करने के लिए एआई दर और दृश्य एआई स्कोर का उपयोग करके परिणामों को वर्गीकृत करता है।

एआई इमेज डिटेक्टर

कृत्रिम बुद्धिमत्ता से उत्पन्न पाठों को मानवीय लेखन के समान बनाएं। परिष्कृत सामग्री स्पष्टता बनाए रखते हुए पहचान की संभावना को कम करती है।

यह उन्नत पहचान एल्गोरिदम के माध्यम से नकल की गई सामग्री का पता लगाता है और अनजाने में हुई साहित्यिक चोरी की पहचान करता है।

व्याकरण, विराम चिह्नों और वाक्य संरचना की गलतियों को पहचानें और ठीक करें। एक क्लिक में पठनीयता में सुधार करें।

सबमिशन से पहले अनदेखी की गई गलतियों का पता लगाने के लिए टोन, संरचना और पठनीयता स्कोर की समीक्षा करें।

अंग्रेजी, स्पेनिश, फ्रेंच, जर्मन, जापानी, हंगेरियन और अन्य भाषाओं में कृत्रिम रूप से लिखे गए लेखों का पता लगाएं।

मूल भाव और संदर्भ को बरकरार रखते हुए 104 भाषाओं में सामग्री का अनुवाद करें।

निबंधों में एआई पैटर्न, साहित्यिक चोरी और संरचना की जांच करें। निष्पक्ष मूल्यांकन में सहायता करता है।

लंबे दस्तावेज़ों को संक्षिप्त सारांशों में बदलें। केंद्रित सारांश जानकारी को सरल और स्पष्ट रखता है।

वाक्यों को इस प्रकार से पुनः लिखें जिससे स्पष्टता बढ़े और मूल भाव को खोए बिना पुनरावृत्ति से बचा जा सके।

पठनीयता और प्रवाह को बेहतर बनाने के लिए समानार्थी शब्दों का प्रयोग करके वाक्यों और अनुच्छेदों को पुनः लिखें।

जाँच प्रक्रिया शुरू करने के लिए सीधे टेक्स्ट पेस्ट करें। एक URL दर्ज करें या DOCX, PDF, TXT या RTF फ़ाइलें अपलोड करें। CudekAI AI डिटेक्टर 15000 अक्षरों तक स्कैन करता है।

शब्द-स्तर, वाक्य-स्तर, पैराग्राफ-स्तर और दस्तावेज़-स्तर का विश्लेषण करने के लिए एआई चेकर चलाएँ। एआई डिटेक्टर स्वचालित रूप से एआई द्वारा उत्पन्न और नकल की गई सामग्री की जाँच करता है।

CudekAI डिटेक्टर कुछ ही सेकंड में टेक्स्ट को स्कैन कर लेगा। विस्तृत रिपोर्ट को PDF और DOCX फॉर्मेट में डाउनलोड करें या एक शेयर करने योग्य लिंक बनाएं।

शीर्ष एआई मॉडल द्वारा उत्पन्न एआई सामग्री का पता लगाएं

यह GPT-5, GPT-4, GPT-3, GPT-4.1 और GPT-4.1-Mini द्वारा उत्पन्न सामग्री का पता लगाता है। सटीक AI संभाव्यता स्कोरिंग विश्वसनीय विश्लेषण सुनिश्चित करती है।

CudeKAI एआई चेकर संरचित विश्लेषण के साथ जेमिनी 3, जेमिनी 2.5 प्रो, जेमिनी 2.5 फ्लैश और जेमिनी 2.5 फ्लैश-लाइट द्वारा टेक्स्ट का पता लगाता है।

वाक्य-स्तर और दस्तावेज़-स्तर के विश्लेषण का उपयोग करके क्लाउड सॉनेट 4 से रोबोटिक पाठ की पहचान करें।

एआई डिटेक्टर लामा द्वारा उत्पन्न भाषाई पैटर्न की पहचान करता है।

एडैप्टिव एआई फिंगरप्रिंट विश्लेषण के साथ डीपसीक मॉडल द्वारा उत्पन्न टेक्स्ट का पता लगाता है

क्रॉस-मॉडल तुलना तर्क का उपयोग करके ग्रोक द्वारा निर्मित एआई-लिखित सामग्री का विश्लेषण करें।

CudekAI विश्वसनीय एआई पहचान के लिए एक उच्च सटीकता वाले मॉडल का उपयोग करता है। स्वतंत्र बेंचमार्किंग और बड़े पैमाने पर परीक्षण इसकी पहचान सटीकता को सत्यापित करते हैं। एआई डिटेक्टर मॉडल गलत सकारात्मक परिणामों और गलत वर्गीकरणों को कम करता है, जबकि बेंचमार्क कई एआई मॉडलों में सुसंगत प्रदर्शन की पुष्टि करते हैं।

CudekAI शैक्षणिक संस्थानों, कॉलेजों और विश्वविद्यालयों में शिक्षकों, छात्रों और शोधकर्ताओं द्वारा विश्वसनीय है। स्कूल प्रणाली निबंधों, शोध पत्रों और ब्लॉग सामग्री में कृत्रिम बुद्धिमत्ता (एआई) की जांच करने और सटीक सत्यापन के लिए एआई डिटेक्टर का उपयोग करती है।

कॉपीराइटर, मार्केटर, रिक्रूटर, पब्लिशर और लेखक इसके सटीक एआई डिटेक्शन स्कोर पर भरोसा करते हैं। हर सबमिशन का विश्लेषण यह सुनिश्चित करने के लिए किया जाता है कि उच्च स्तरीय सामग्री मौलिकता मानकों को पूरा करती है।

एजेंसियों के लिए सर्वश्रेष्ठ

Credits: Tailored for You

एआई डिटेक्टर

मानवीकरणकर्ता

साहित्यिक चोरी जाँचकर्ता

एआई इमेज डिटेक्टर

सभी ऐप्स शामिल हैं

अनुवादक

यह API एकीकरण के साथ बल्क AI डिटेक्शन करता है। इसमें सामग्री इनपुट करके और स्वचालित जांच के लिए AI डिटेक्टर तक API पहुंच प्राप्त करके यह कार्य किया जाता है। API AI डिटेक्शन, साहित्यिक चोरी की जांच, पैराफ्रेज़िंग और अनुवाद का समर्थन करता है।

आज ही एपीआई एक्सेस प्राप्त करें।

नि:शुल्क ऐ सामग्री खोजक उपकरण 103 भाषा में उपलब्ध है

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

Cudekai का एआई डिटेक्टर मेरे लिए सचमुच तनाव कम करने वाला साबित हुआ है। मेरे कुछ प्रोफेसर एआई द्वारा लिखित कार्यों को लेकर काफी सख्त हैं, और यह टूल मुझे यह भरोसा दिलाता है कि जमा करने से पहले मेरे शोध पत्र प्रामाणिक प्रतीत होते हैं।

Daniel

अपने लेख पूरे करने के बाद, मैं Cudekai के ह्यूमननाइज़र टूल का उपयोग करता हूँ ताकि यह सुनिश्चित हो सके कि वे वास्तव में मेरी अपनी आवाज़ की तरह लगें। यह लेखन को सहज बनाता है और सब कुछ स्वाभाविक रूप से प्रवाहित होने लगता है—बिल्कुल मेरी अपनी आवाज़ की तरह, बस थोड़ा और परिष्कृत।

Chelsea

जब भी मुझे किसी बात को दोबारा लिखने में दिक्कत होती है, तो मैं उसे Cudekai के रीराइटर में डाल देता हूँ। इससे मुझे कुछ ही सेकंड में साफ-सुथरे और स्पष्ट संस्करण मिल जाते हैं और मेरा बहुत सारा समय बच जाता है, जिसका इस्तेमाल मैं दूसरे कामों में कर सकता हूँ।

Ricardo

Cudekai का साहित्यिक चोरी जांचने वाला टूल वाकई बहुत बढ़िया है। रिपोर्ट विस्तृत होने के साथ-साथ समझने में भी आसान हैं, जिससे समस्याओं को जल्दी ठीक किया जा सकता है। मेरे प्रोजेक्ट्स के लिए यह बेहद ज़रूरी है।

Michael